Modifier le trafic réseau sans interrompre les connexions

Combien de fois avez-vous dû planifier une fenêtre de maintenance complexe simplement pour ajouter une logique de routage spécifique à votre infrastructure existante ? Pendant de nombreuses années, l'extension d'un Service Mesh nécessitait de recompiler l'intégralité du proxy réseau ou de déployer des services externes d'autorisation particulièrement lents. Cette approche monolithique et rigide appartient désormais au passé grâce à l'émergence de standards d'extensibilité dynamiques qui bouleversent notre conception de l'architecture distribuée.

Concrètement, un maillage de services représente la couche d'infrastructure dédiée à la sécurisation, au routage et au contrôle des communications entre vos microservices. En introduisant des environnements d'exécution isolés directement au cœur de ce système d'interception, nous sommes désormais capables d'injecter du code métier complexe à la volée. C'est précisément ici que la synergie entre des langages de programmation systèmes performants et des formats binaires portables prend tout son sens pour manipuler les requêtes HTTP en temps réel.

Dans ce tutoriel pratique, nous allons construire de bout en bout un filtre réseau personnalisé capable d'altérer intelligemment le trafic entrant. Nous utiliserons le kit de développement officiel pour forger notre logique algorithmique avant de la compiler et de l'injecter dynamiquement dans le flux de requêtes. Préparez votre environnement de développement local, car nous allons plonger profondément dans les entrailles de l'ingénierie d'interception moderne.

La mécanique interne de l'interception et de l'isolation

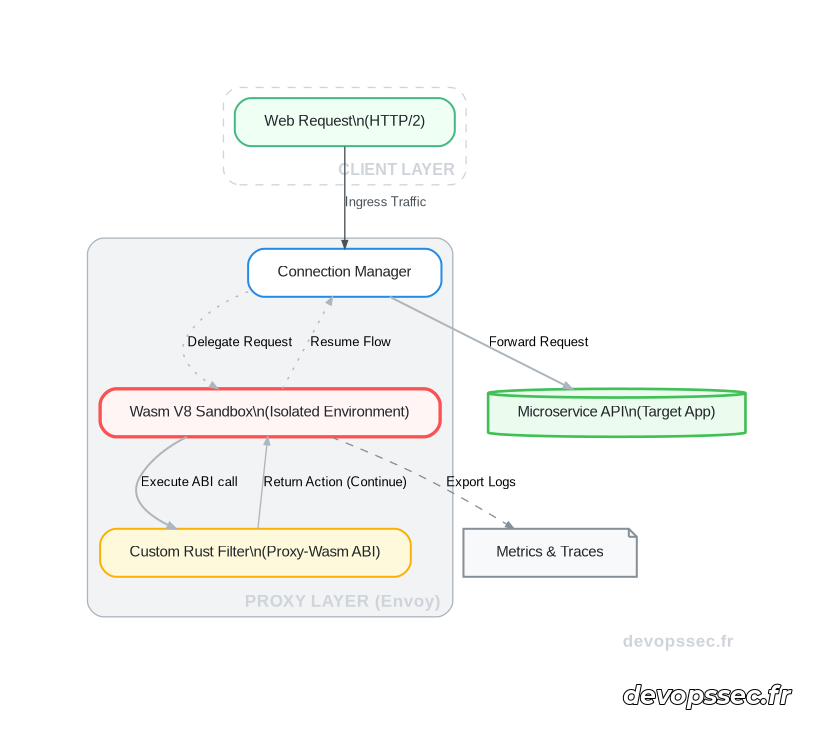

Pour maîtriser ce que nous allons implémenter, il est indispensable d'analyser en profondeur la manière dont le proxy délègue le traitement des paquets applicatifs. Historiquement, écrire un filtre réseau exigeait de maîtriser des concepts avancés en C++ et d'intégrer son code directement dans la volumineuse base source de l'application hôte. Aujourd'hui, l'API Proxy-Wasm agit comme une interface standardisée universelle qui découple totalement la logique métier du cycle de vie du proxy lui-même.

Comme l'illustre le schéma d'architecture ci-dessus, lorsqu'une requête légitime atteint le composant d'écoute, ce dernier suspend de façon éphémère l'exécution du thread principal. Il transmet ensuite le contexte mémoire de la requête à une machine virtuelle légère intégrée qui exécute notre module binaire de manière strictement encapsulée. Une fois notre logique de modification d'en-têtes appliquée avec succès, le module virtuel rend la main au gestionnaire réseau qui poursuit son cheminement vers le microservice de destination final.

Indépendance vis-à-vis de l'infrastructure

Le standard d'interception présenté repose sur une interface binaire d'application (ABI) totalement agnostique. Cela signifie que le module binaire que vous allez générer fonctionnera à l'identique sur Envoy, Istio, ou tout autre composant réseau supportant cette norme d'exécution isolée.

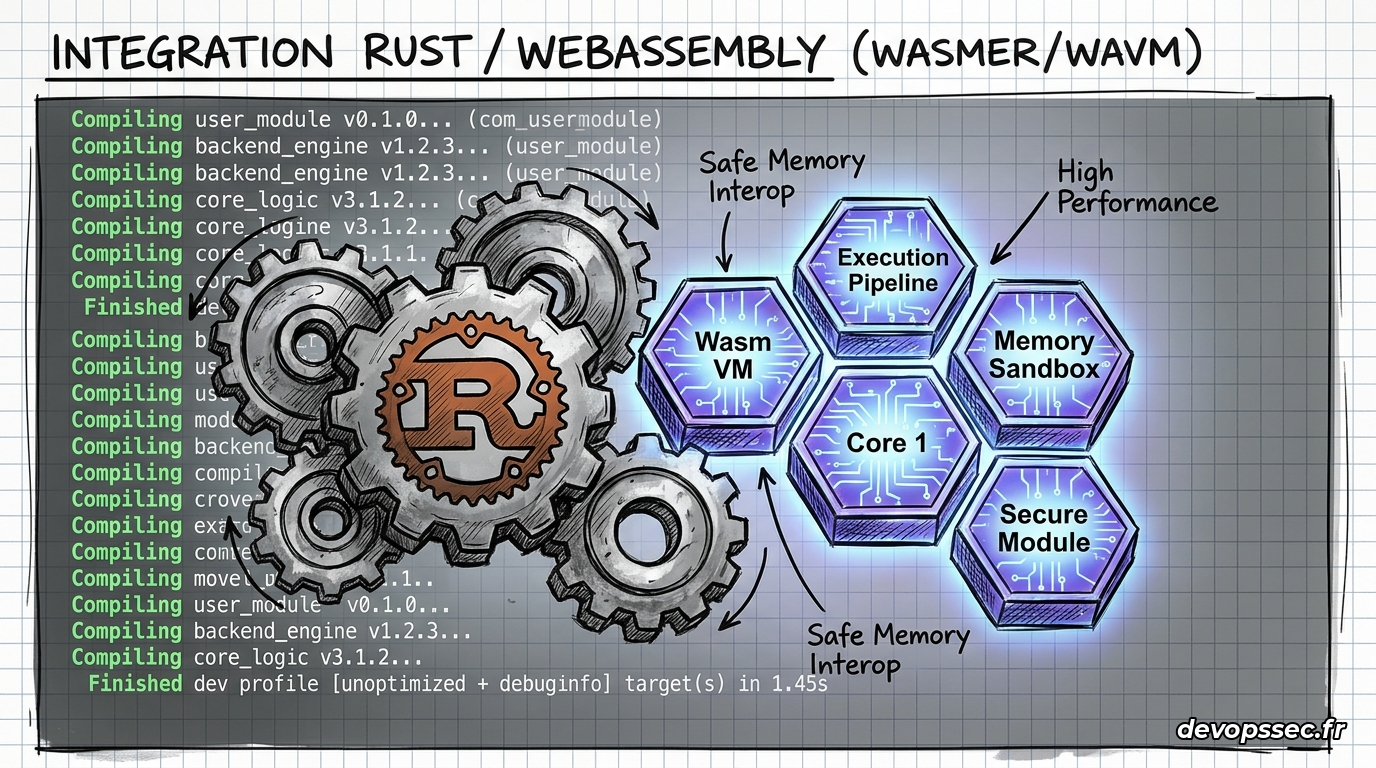

Forger l'extension réseau avec l'écosystème Rust

La création technique de notre filtre personnalisé débute invariablement par un choix stratégique concernant le langage de programmation. Bien qu'il soit techniquement possible de faire appel à Go ou AssemblyScript, Rust s'impose naturellement comme le candidat idéal pour générer un module WebAssembly grâce à sa gestion stricte de la mémoire non allouée. Ces caractéristiques intrinsèques garantissent une empreinte mémoire infinitésimale et des performances d'exécution hautement prédictibles, des qualités vitales pour un composant réseau critique.

Pour initier proprement la base de code, nous devons structurer minutieusement notre répertoire de travail et configurer les chaînes de compilation adéquates. Positionnez-vous dans votre espace de développement habituel, naviguez vers le chemin absolu /opt/dev/mesh-filters/, puis initialisez une nouvelle bibliothèque standard. Il est fondamental de préciser au gestionnaire de paquets que nous souhaitons produire un fichier objet dynamique spécifique, et non un simple exécutable binaire natif.

cargo new --lib envoy_security_filter

cd envoy_security_filter

rustup target add wasm32-unknown-unknownRésultat:

Created library `envoy_security_filter` package

info: downloading component 'rust-std' for 'wasm32-unknown-unknown'

info: installing component 'rust-std' for 'wasm32-unknown-unknown'Maintenant que les fondations logicielles sont solidement établies, nous allons modifier le manifeste déclaratif du projet afin d'y importer la dépendance principale de développement. Ouvrez votre éditeur favori sur le fichier Cargo.toml et spécifiez le type de crate en tant que cdylib. C'est précisément cette directive de configuration qui force la chaîne d'outils du compilateur à générer une bibliothèque dynamique en langage C, format unique accepté par la machine virtuelle de notre proxy hôte.

[package]

name = "envoy_security_filter"

version = "0.1.0"

edition = "2021"

[lib]

crate-type = ["cdylib"]

[dependencies]

proxy-wasm = "0.2.1"

log = "0.4.17"Implémentation algorithmique de la logique de filtrage

L'écriture effective du code source s'articule autour de l'implémentation de traits spécifiques au langage pour définir le comportement du proxy. Nous devons implémenter le trait Context pour configurer le cycle de vie général du plugin, ainsi que le trait HttpContext pour interagir finement avec les métadonnées des flux entrants. Dans l'exemple suivant, nous développons une routine de sécurité élémentaire consistant à injecter systématiquement un jeton de traçabilité dans l'en-tête de chaque requête valide.

use proxy_wasm::traits::*;

use proxy_wasm::types::*;

proxy_wasm::main_{{

proxy_wasm::set_log_level(LogLevel::Trace);

proxy_wasm::set_http_context(|context_id, _| -> Box {

Box::new(SecurityFilter { context_id })

});

}}

struct SecurityFilter {

context_id: u32,

}

impl Context for SecurityFilter {}

impl HttpContext for SecurityFilter {

fn on_http_request_headers(&mut self, _: usize, _: bool) -> Action {

self.set_http_request_header("x-custom-security-token", "verified-by-rust");

log::info!("Requête interceptée par le contexte ID : {}", self.context_id);

Action::Continue

}

} Dès que la syntaxe de votre algorithme vous satisfait, il vous suffit de lancer la commande de génération ciblée via l'instruction cargo build --target wasm32-unknown-unknown --release directement dans votre terminal interactif. Le compilateur de la chaîne Rust va alors optimiser agressivement les chemins d'exécution pour expulser un artefact binaire remarquablement compact, logé dans le sous-dossier des cibles de production. Ce composant est instantanément prêt à être ingéré par le système d'orchestration.

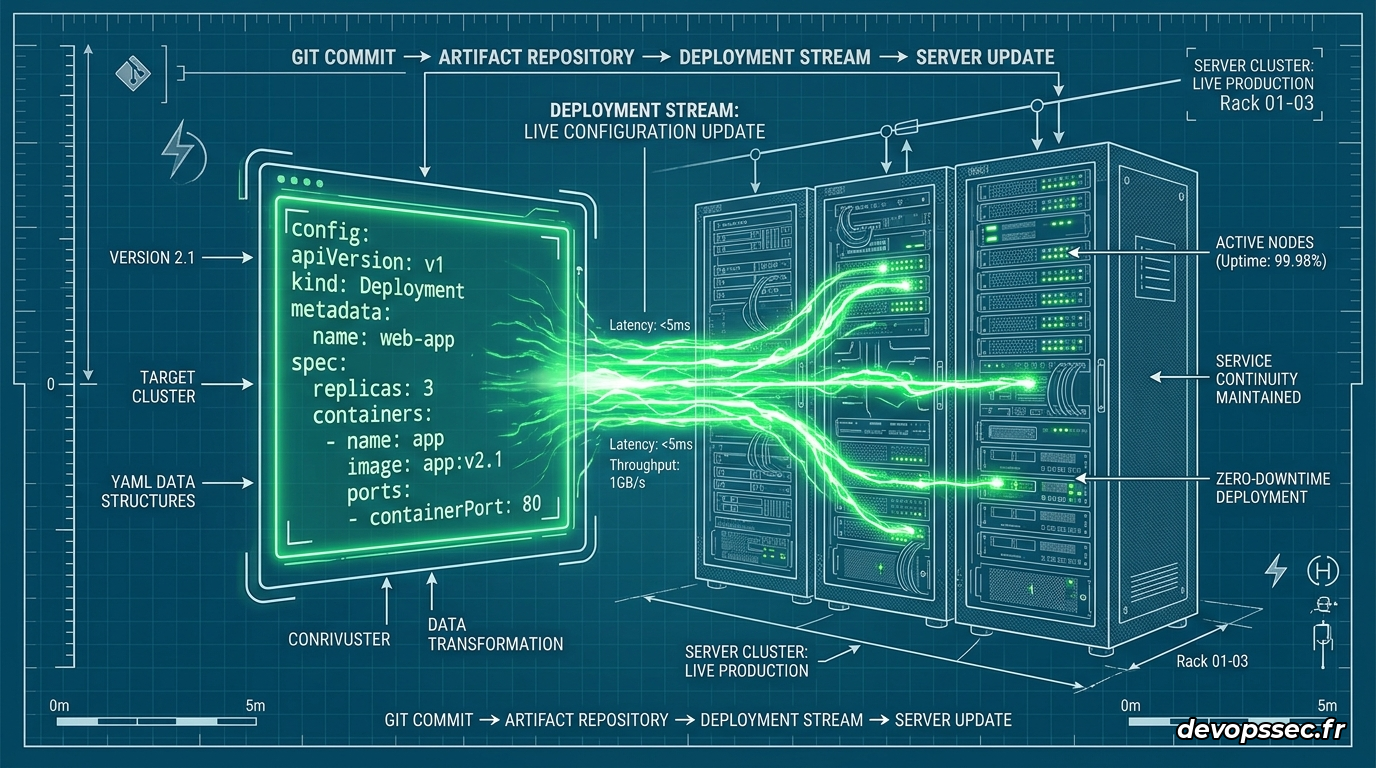

Déploiement dynamique au cœur de l'infrastructure Envoy

La véritable puissance de notre toute nouvelle extension logicielle réside dans son extraordinaire capacité à être chargée à chaud par le composant de routage. Pour accomplir cette prouesse technique, nous allons ajuster la chaîne de filtres HTTP du proxy en enrichissant son fichier de déclaration principal. Cette configuration avancée indique explicitement au processus démon où localiser le fichier compilé sur le système de fichiers et de quelle manière l'imbriquer logiquement dans l'arbre d'exécution des écouteurs de trafic.

Observez avec la plus grande attention la structure du manifeste de configuration qui va suivre. La section dévolue aux traitements HTTP intègre dorénavant une déclaration spécifique qui instancie le moteur d'exécution V8 interne. En stipulant rigoureusement le nom du runtime attendu, le proxy assimile qu'il doit cloner et amorcer notre logique métier exclusive à l'instant exact où une nouvelle connexion TCP de type applicative est acceptée par les sockets du système d'exploitation sous-jacent.

admin:

address:

socket_address:

protocol: TCP

address: 0.0.0.0

port_value: 9901

static_resources:

listeners:

- name: ingress_listener

address:

socket_address:

address: 0.0.0.0

port_value: 8080

filter_chains:

- filters:

- name: envoy.filters.network.http_connection_manager

typed_config:

"@type": type.googleapis.com/envoy.extensions.filters.network.http_connection_manager.v3.HttpConnectionManager

stat_prefix: ingress_http

http_filters:

- name: envoy.filters.http.wasm

typed_config:

"@type": type.googleapis.com/envoy.extensions.filters.http.wasm.v3.Wasm

config:

name: "security_filter_rust"

vm_config:

runtime: "envoy.wasm.runtime.v8"

code:

local:

filename: "/etc/envoy/proxy/envoy_security_filter.wasm"

- name: envoy.filters.http.routerUne fois cette modification topologique sauvegardée sur vos serveurs virtuels, le mécanisme de découverte de ressources d'Envoy va interpréter cette altération sans provoquer la moindre chute de requêtes en cours de traitement. En réalisant un simple appel avec un outil client curl ciblant votre nouvelle interface d'écoute, vous constaterez avec satisfaction la présence immédiate de l'en-tête de validation cryptographique incrusté au cœur des paquets applicatifs retransmis.

Analyse critique : limites et coûts d'architecture

Malgré l'immense flexibilité offerte par ce paradigme de déploiement, l'injection de logique au vol dans les flux applicatifs ne vient pas sans de réelles contreparties opérationnelles. La notion centrale d'Observabilité, pourtant indispensable au fonctionnement sain des maillages de services modernes, s'avère considérablement plus laborieuse à paramétrer. Lorsqu'une panique logicielle ou un crash survient à l'intérieur de la bulle virtuelle isolée, récupérer les traces d'appels détaillées sans détruire les performances globales de l'hôte requiert une configuration chirurgicale de l'exportateur de journaux.

Par ailleurs, bien que le format de compilation binaire se révèle incroyablement performant, chaque interaction entre le proxy natif et l'environnement d'exécution invité déclenche de lourdes opérations de sérialisation de la mémoire. Ce coût de communication incompressible, universellement qualifié de pénalité de changement de contexte, peut croître de manière tout à fait exponentielle si votre module a l'imprudence de tenter d'analyser l'intégralité des corps de réponses plutôt que de se contenter de simples lectures d'en-têtes HTTP.

| Caractéristique technique | Filtre C++ Natif (Intégré) | Filtre Rust (Format WebAssembly) |

|---|---|---|

| Sécurité de l'exécution | Partage de l'espace mémoire (Risque de crash du proxy) | Isolation forte via bac à sable V8 (Sandboxed) |

| Déploiement et mise à jour | Recompilation complexe et redémarrage des nœuds requis | Injection à chaud sans la moindre interruption réseau |

| Latence de traitement | Latence minimale (Exécution native sans conversion) | Surcoût léger dû aux transitions de contexte mémoire |

Il est par conséquent impératif de réserver cette méthodologie d'interception à des cas d'usage métiers où l'agilité organisationnelle du déploiement l'emporte de loin sur la recherche obsessionnelle de la latence microscopique la plus basse possible. Les équipes d'ingénierie de plateforme doivent impérativement instaurer des seuils d'alerte stricts dans leurs outils de supervision et monitorer en permanence l'allocation CPU de ces modules pour anticiper et étouffer tout risque de saturation vicieuse des files d'attente réseau.

Vers une infrastructure réseau fondamentalement programmable

En apprenant à maîtriser le processus de compilation croisée vers des bibliothèques portables et leur injection fluide dans des routeurs de nouvelle génération, vous déverrouillez un niveau de réactivité architecturale sans précédent. L'époque révolue où chaque évolution minime des règles de trafic imposait un pipeline de livraison interminable et conflictuel entre les développeurs logiciels et les ingénieurs d'infrastructures est définitivement effacée. L'adaptation dynamique du comportement des maillages virtuels s'affirme fièrement comme l'approche standard par excellence pour aborder l'ingénierie infonuagique moderne à grande échelle.

Désormais, vous disposez du socle de connaissances nécessaire pour imaginer et concevoir vos propres pare-feux applicatifs intelligents, des systèmes de limitation de fréquence adaptatifs ou encore des transformateurs de données à la volée. N'hésitez pas à expérimenter intensément en validant vos théories dans un cluster local émulé, avant d'étendre progressivement et méthodiquement la portée de vos nouveaux filtres d'interception sur la globalité de votre parc de serveurs de production en direct.

Espace commentaire

Écrire un commentaire

Vous devez être connecté pour poster un message !

20 commentaires

actif

Wasm Envoy Rust c du lourd

actif

Le point sur l'implémentation algorithmique de la logique de filtrage était parfait

actif

Trop bon ce tuto. La section sur le déploiement dynamique au cœur de l'infrastructure Envoy est cruciale

actif

Enfin quelqu'un qui décortique l'isolation réseau

actif

Franchement l'analyse critique est indispensable pour ne pas tomber dans le mythe de la panacée réseau

actif

Génial de voir ça avec Rust ça sécurise le stack

actif

Super guide. La capacité de modifier le trafic sans redémarrer ça change la donne vraiment

actif

J'aimerais trop des exemples concrets sur la mécanique interne

actif

Le tuto est hyper dense mais limpide. L'idée d'une infrastructure réseau fondamentalement programmable est folle

actif

Bravo pour l'approche Rust ça monte en puissance

actif

Nickel la modélisation de l'écosystème réseau ça inspire

actif

Surtout la partie sur la gestion des limites et coûts d'architecture. On fait trop rêver mais la réalité est complexe

Ça m'a fait revoir nos propres contraintes de latence avec cette approche

actif

Le sujet est au top niveau hardcore

actif

Un grand merci. La démo de déploiement dynamique est exactement ce qu'il nous fallait pour le PoC

actif

Passer au Wasm ça simplifie énormément l'isolation des filtres

actif

Franchement c'est un must pour les ops qui veulent sortir du mode 'reboot constant'

actif

Le sommaire est parfait. Le passage du Rust au Wasm c'est la bonne direction pour la robustesse

actif

Ceci change la donne pour le méta-niveau réseau

actif

La compréhension de la mécanique interne de l'interception est vraiment avancée

actif

Super récap sur le filtrage. La section analyse critique est cruciale pour l'industrialisation