L'AIOps Révolutionne les Opérations : Vers la Prédictivité et l'Autonomie

Vous avez déjà ressenti cette impression de noyade face à des milliers de lignes de logs après un incident en production ? Ce flux incessant d'alertes qui, au final, crée plus de bruit que de signal ? Ce sentiment est le symptôme d'une complexité qui dépasse désormais notre capacité humaine à réagir. C'est précisément ici que l'AIOps entre en scène, non pas comme un simple outil, mais comme un changement de paradigme fondamental.

Déconstruire le concept : Qu'est-ce que l'AIOps ?

Loin d'être un simple mot à la mode, l'AIOps (Artificial Intelligence for IT Operations) désigne l'application de l'intelligence artificielle, et plus spécifiquement de l'apprentissage automatique (Machine Learning), aux opérations informatiques. L'idée centrale est de passer d'une supervision réactive, où l'on attend qu'un problème survienne pour le corriger, à une gestion proactive et prédictive des infrastructures et des applications.

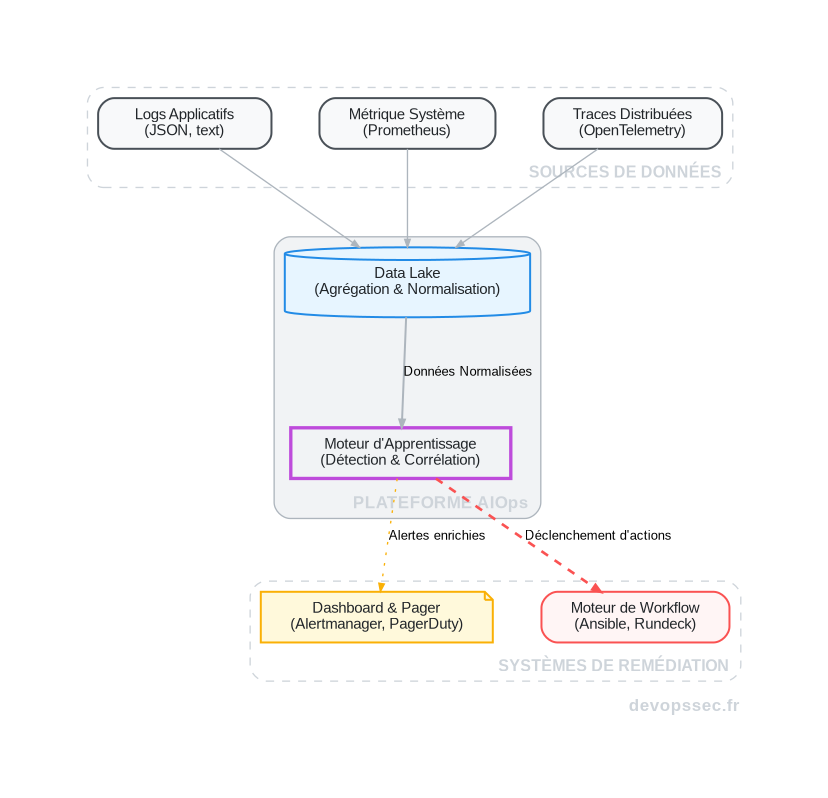

Concrètement, une plateforme AIOps ingère des volumes massifs de données provenant de sources hétérogènes : logs, métriques, traces applicatives, tickets d'incidents. Ensuite, ses algorithmes analysent ces données en temps réel pour détecter des schémas anormaux, corréler des événements apparemment sans lien et identifier la cause racine d'un problème bien avant qu'il n'impacte les utilisateurs finaux.

Les trois piliers fonctionnels de l'AIOps

Pour bien saisir sa puissance, il faut penser l'AIOps comme un processus en trois temps : observer, engager et agir. Cette boucle vertueuse permet de transformer le chaos des données brutes en actions intelligentes et automatisées, libérant ainsi les équipes opérationnelles des tâches répétitives et à faible valeur ajoutée.

- Observer : La première étape consiste en une collecte massive et centralisée de toutes les données opérationnelles. On parle ici de tout ce qui compose l'Observabilité d'un système, des métriques CPU aux traces distribuées en passant par les logs applicatifs et les événements de sécurité.

- Engager : C'est le cœur de l'intelligence. Les moteurs de Machine Learning et de Big Data analysent les données collectées pour séparer le signal du bruit. Ils réalisent une corrélation d'événements, une détection d'anomalies statistiques et une Analyse Causale (Root Cause Analysis) pour identifier l'origine réelle d'une défaillance.

- Agir : Sur la base des analyses, la plateforme peut déclencher des actions correctives. Cela peut aller de la simple notification enrichie envoyée à la bonne équipe, à l'exécution de runbooks d'automatisation pour redémarrer un service, scaler une infrastructure ou bloquer une adresse IP malveillante.

Monitoring traditionnel vs AIOps : Le saut quantique

Il est crucial de ne pas confondre l'AIOps avec les outils de monitoring classiques. Le monitoring traditionnel se base sur des seuils statiques que vous définissez manuellement. L'AIOps, lui, apprend le comportement "normal" de votre système et détecte les déviations, même les plus subtiles. C'est la différence entre une alarme incendie qui se déclenche quand la maison brûle et un système qui vous prévient d'un court-circuit avant même la première étincelle.

| Critère | Monitoring Traditionnel | AIOps |

|---|---|---|

| Approche | Réactive (basée sur des seuils fixes) | Proactive et Prédictive (basée sur l'apprentissage) |

| Source de données | Silos de données (métriques, logs séparés) | Agrégation de données hétérogènes |

| Détection | Manuelle, basée sur des règles prédéfinies | Automatique, détection d'anomalies dynamiques |

| Analyse Causale | Humaine, nécessite une expertise tribale | Assistée par l'IA, corrélation d'événements |

| Automatisation | Limitée à des scripts simples | Workflows complexes et remédiation autonome |

Anatomie d'un pipeline AIOps en pratique

Comprendre la théorie, c'est bien. Mais pour vraiment saisir la portée de l'AIOps, il faut visualiser comment les données circulent et sont transformées. L'architecture d'un tel système est conçue pour transformer un flot de données brutes en décisions opérationnelles claires et rapides.

Configurer la collecte de données

Tout commence par une collecte de données exhaustive et de qualité. Sans un carburant de bonne qualité, le moteur d'Apprentissage Automatique (Machine Learning) ne produira que des résultats médiocres. C'est le fameux principe du "Garbage In, Garbage Out". Chaque source de données, qu'il s'agisse de vos serveurs Kubernetes, de vos bases de données ou de vos applications, doit être équipée d'un agent capable de formater et d'expédier les informations vers la plateforme centrale.

Voici à quoi pourrait ressembler un extrait de configuration d'un agent de collecte de logs, comme Vector, pour récupérer les logs d'un conteneur et les enrichir avec des métadonnées Kubernetes avant de les envoyer vers un data lake.

# Fichier de configuration : vector.yaml

sources:

kubernetes_logs:

type: "kubernetes_logs"

# Auto-découverte des pods à surveiller

glob_minimum_cooldown_ms: 15000

transforms:

add_metadata:

type: "remap"

inputs:

- "kubernetes_logs"

# Ajoute les labels du pod aux métadonnées du log

source: |-

.kubernetes.pod_labels = {{kubernetes.pod_labels}}

.message = .message

sinks:

aiops_platform:

type: "http"

inputs:

- "add_metadata"

uri: "https://ingest.my-aiops-platform.com"

encoding:

codec: "json"La qualité avant la quantité

Ne vous contentez pas de tout envoyer. Avant d'ingérer une nouvelle source de données, posez-vous la question de sa pertinence. Des données structurées et enrichies (comme l'ajout de labels Kubernetes) auront infiniment plus de valeur pour les algorithmes d'analyse que des logs textuels bruts.

Les angles morts de l'AIOps : Coûts, complexité et confiance

Adopter l'AIOps n'est pas une solution miracle. C'est un projet de transformation profond qui comporte son lot de défis. Ignorer ces aspects reviendrait à naviguer en pleine tempête sans carte ni boussole. Il est donc essentiel de les aborder avec lucidité avant de se lancer.

Le premier obstacle, et non des moindres, est la complexité inhérente à ces systèmes. Mettre en place et maintenir une plateforme AIOps efficace requiert des compétences pointues qui sont rares et donc coûteuses. Vous aurez non seulement besoin d'ingénieurs DevOps, mais aussi de Data Scientists capables de comprendre, d'ajuster et d'interpréter les modèles d'apprentissage automatique.

De plus, le coût financier peut être conséquent. Entre les licences des plateformes commerciales, l'infrastructure de calcul nécessaire pour traiter des pétaoctets de données et les salaires des experts, la facture peut vite grimper. Il faut donc s'assurer que le retour sur investissement, en termes de réduction du temps moyen de résolution (MTTR) et d'amélioration de la disponibilité, soit au rendez-vous.

Enfin, la question de la confiance est primordiale. Certains modèles de Machine Learning peuvent se comporter comme des "boîtes noires", rendant leurs décisions difficiles à expliquer. Autoriser un système automatisé à effectuer des changements en production (comme un rollback ou un redémarrage de service) sur la base d'une décision opaque peut être un risque que toutes les organisations ne sont pas prêtes à prendre.

Conclusion : L'aube d'une nouvelle ère pour les opérations

Malgré les défis, l'AIOps représente sans aucun doute l'avenir des opérations IT. Dans un monde où les architectures microservices et le cloud natif génèrent une complexité exponentielle, les approches humaines traditionnelles ne suffisent plus. L'intelligence artificielle n'est plus une option, mais une nécessité pour maintenir des systèmes résilients et performants.

L'objectif n'est pas de remplacer les ingénieurs humains, mais de les augmenter. En déléguant la détection et la remédiation des problèmes courants à la machine, l'AIOps libère un temps précieux pour que les équipes puissent se concentrer sur l'innovation, l'architecture et la résolution de problèmes complexes à forte valeur ajoutée. Nous entrons dans une ère où l'IT devient moins réactive et plus stratégique, guidée par la donnée et l'intelligence prédictive.

Espace commentaire

Écrire un commentaire

Vous devez être connecté pour poster un message !

14 commentaires

L'efficacité inédite c'est ce qu'on vise avec l'AIOps

On cherche à passer à la détection d'anomalies proactive

Cet article donne des bonnes pistes concrètes pour notre projet

la confiance dans les algos c'est crucial

Article qui met bien le doigt dessus

Superbe intro pour déconstruire le concept

L'autonomie c'est le rêve pour nos équipes de garde

Une nouvelle ère pour les opérations clairement

Notre pipeline AIOps ressemble déjà à ça bon signe

Les angles morts sur les coûts et la complexité sont bien soulignés

Faut y penser avant de se lancer tête baissée

Les trois piliers fonctionnels c'est la base

La config de la collecte de données c'est là que ça se joue

Le concept de l'AIOps enfin clair pour les équipes

Saut quantique bien décrit

Le monitoring traditionnel est clairement dépassé

L'AIOps révolutionne vraiment les opérations

C'est exactement notre next step pour la prédictivité