L'angle mort de notre industrie : le coût énergétique du code

On nous a vendu le numérique comme une révolution immatérielle, une abstraction élégante où la donnée circule sans contrainte. Pourtant, derrière chaque ligne de code exécutée, chaque requête API traitée, se cache une réalité bien physique : des serveurs qui chauffent, des climatiseurs qui tournent à plein régime et une consommation électrique qui rivalise avec celle de certains pays.

L'ingénierie logicielle durable n'est plus une simple curiosité académique, mais une discipline émergente au carrefour du DevOps, du FinOps et de la responsabilité sociétale. Il ne s'agit plus seulement de livrer vite, mais de livrer de manière efficiente, en minimisant l'empreinte carbone de nos applications dès leur conception.

Cette approche, que l'on pourrait qualifier de "DevOps Vert", consiste à intégrer la performance énergétique comme un indicateur de qualité non fonctionnel, au même titre que la sécurité ou la latence. C'est un changement de paradigme qui te place, en tant que développeur ou ingénieur DevOps, en première ligne de la transition écologique de notre secteur.

Les trois dimensions de l'éco-conception logicielle

Construire une application durable repose sur une vision holistique qui va bien au-delà de l'optimisation d'un simple algorithme. Pour être véritablement efficace, cette démarche doit s'appliquer à trois niveaux interdépendants : le code que nous écrivons, l'infrastructure qui l'héberge et les outils que nous utilisons pour mesurer son impact.

Le code : la performance comme premier levier écologique

Chaque cycle CPU non optimisé, chaque requête de base de données superflue, chaque allocation mémoire inutile se traduit directement par une consommation d'énergie. Un code performant est, par nature, un code plus écologique. L'idée est de chasser le gaspillage à la source même de la création de valeur.

Concrètement, cela signifie revenir aux fondamentaux de l'informatique avec une conscience énergétique renouvelée. Pense à la complexité algorithmique, au choix de tes structures de données et à la manière dont ton application interagit avec les services externes. Un appel réseau qui attend une réponse pendant une seconde maintient une connexion active et consomme des ressources inutilement.

Voici quelques pistes pratiques à intégrer dans tes revues de code :

- Optimisation des requêtes : Traquer les problèmes de type N+1, utiliser des projections pour ne récupérer que les données nécessaires et mettre en cache les requêtes fréquentes sont des gestes à impact immédiat.

- Choix des bibliothèques : Une dépendance légère et spécialisée sera toujours plus efficiente qu'un framework massif dont tu n'utilises que 10% des fonctionnalités. Analyse le poids et la performance de tes dépendances.

- Gestion de la concurrence : L'utilisation de modèles asynchrones et non bloquants permet de mieux utiliser les ressources du processeur, en évitant que des threads restent en attente et consomment de l'énergie pour rien.

- Sobriété des données : Transférer des objets JSON volumineux sur le réseau a un coût. Adopte des formats binaires plus compacts comme Protobuf ou Avro lorsque c'est pertinent.

L'infrastructure : du "Right-Sizing" au "Green-Sizing"

L'infrastructure qui exécute notre code est le deuxième pilier majeur de l'ingénierie logicielle durable. Le cloud a apporté une flexibilité incroyable, mais aussi une tendance à surdimensionner les ressources "au cas où", conduisant à un gaspillage massif de serveurs tournant à vide.

Le "Green-Sizing" va plus loin que le simple "Right-Sizing". Il ne s'agit pas seulement de choisir la bonne taille d'instance, mais aussi de choisir le bon type de processeur, la bonne région cloud et la bonne architecture. Les processeurs basés sur l'architecture ARM, par exemple, offrent souvent un bien meilleur ratio performance par watt que leurs équivalents x86 pour de nombreuses charges de travail.

| Approche d'Infrastructure | Avantages Énergétiques | Inconvénients et Contraintes |

|---|---|---|

| Machines Virtuelles (VM) classiques | Isolation forte, écosystème mature. | Gaspillage élevé (OS complet par VM), démarrage lent, faible densité. |

| Conteneurs (Kubernetes) | Haute densité, démarrage rapide, partage du noyau de l'OS. | Nécessite une orchestration complexe, la consommation de l'orchestrateur lui-même n'est pas négligeable. |

| Serverless (Functions-as-a-Service) | Consommation à l'usage (pas de coût au repos), mise à l'échelle à zéro. Idéal pour les charges de travail sporadiques. | Démarrages à froid (cold starts), limites sur la durée d'exécution et la mémoire, "vendor lock-in". |

De plus, le choix de la région où déployer ton application n'est pas anodin. Certains fournisseurs de cloud publient désormais l'intensité carbone de leurs datacenters, te permettant de déployer tes charges de travail non critiques dans des régions alimentées majoritairement par des énergies renouvelables.

Intégrer la mesure carbone dans la pipeline CI/CD

Le vieil adage "on ne peut améliorer que ce que l'on mesure" n'a jamais été aussi vrai. Pour transformer ces principes en une pratique d'ingénierie rigoureuse, il nous faut intégrer une nouvelle forme de monitoring : l'observabilité énergétique. Cela consiste à collecter des métriques sur la consommation électrique ou l'empreinte carbone estimée de nos applications.

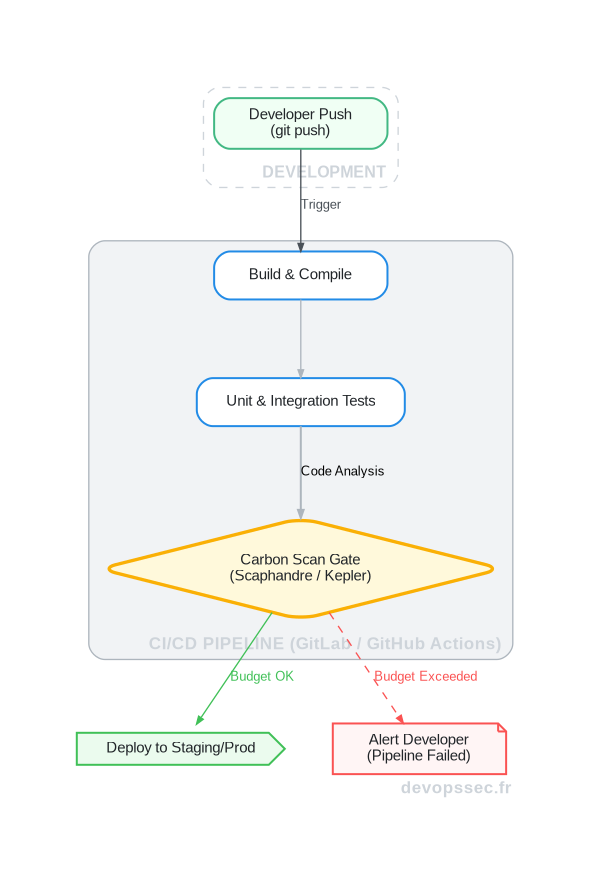

L'objectif est de rendre visible cet impact, traditionnellement invisible, afin de pouvoir prendre des décisions éclairées. En intégrant ces mesures directement dans nos pipelines de CI/CD, nous pouvons créer une boucle de rétroaction rapide pour les développeurs.

Ce schéma illustre une pipeline moderne où, après les étapes classiques de build et de test, une nouvelle étape de "Carbon Scan" est introduite. Ce "quality gate" énergétique utilise des outils pour estimer l'impact de la nouvelle modification. Si l'augmentation de la consommation dépasse un seuil prédéfini, la pipeline échoue et alerte le développeur, tout comme elle le ferait pour une régression de performance ou une faille de sécurité.

Exemple de "Quality Gate" énergétique avec GitLab CI

Imagine un fichier .gitlab-ci.yml qui intègre un outil d'analyse énergétique. L'étape carbon_scan exécute un script qui compare l'empreinte de la branche actuelle par rapport à la branche principale et fait échouer le job si la dégradation est trop importante.

stages:

- build

- test

- green_scan

- deploy

# ... autres jobs de build et test ...

carbon_scan:

stage: green_scan

image: rust:latest # Image contenant l'outil d'analyse comme Scaphandre

script:

# 1. Lancer l'application en mode profiling énergétique

- scaphandre json -t 60 -f /tmp/report.json -- /usr/local/bin/my_app &

# 2. Exécuter une suite de tests de charge pour simuler une utilisation réelle

- run-load-tests.sh http://localhost:8080

# 3. Analyser le rapport et comparer au seuil

- |

CONSUMPTION=$(cat /tmp/report.json | jq '.consumers[0].consumption')

THRESHOLD=150000 # Seuil en micro-watts/h

if [ $(echo "$CONSUMPTION > $THRESHOLD" | bc -l) -eq 1 ]; then

echo "Régression énergétique détectée ! Consommation: $CONSUMPTION, Seuil: $THRESHOLD"

exit 1

else

echo "Analyse énergétique validée. Consommation: $CONSUMPTION"

fi

rules:

- if: '$CI_PIPELINE_SOURCE == "merge_request_event"'Ce type d'automatisation transforme une intention louable en une pratique d'ingénierie systématique et mesurable. Elle incite les équipes à discuter de l'impact énergétique de leurs choix techniques lors des revues de code.

Quand écologie rime avec économie : le lien avec le FinOps

L'un des arguments les plus puissants en faveur du DevOps Vert est son alignement direct avec les objectifs du FinOps, cette discipline qui vise à maîtriser et optimiser les coûts liés au cloud. Moins de CPU consommé, c'est moins de facturation. Moins de données transférées, c'est une facture réseau allégée. Des ressources mieux dimensionnées, ce sont des économies directes.

Cette convergence est une aubaine. Elle permet de justifier les investissements en temps et en outillage pour l'ingénierie durable non pas comme un coût, mais comme un centre de profit. Chaque optimisation qui réduit l'empreinte carbone a de fortes chances de réduire également la facture cloud, créant un cercle vertueux.

Parler le langage du business

Lorsque tu proposes une initiative d'éco-conception, présente-la à ton management sous l'angle du retour sur investissement. Utilise les calculateurs de coût des fournisseurs cloud pour modéliser les économies potentielles. L'argument écologique deviendra alors une conséquence positive et valorisante d'une décision business rationnelle.

Les défis et les angles morts de l'approche

Cependant, il faut rester lucide. L'ingénierie logicielle durable n'est pas une solution miracle et comporte ses propres défis. La mesure de la consommation énergétique, surtout dans un environnement virtualisé et partagé comme le cloud, reste une science inexacte qui repose souvent sur des modèles et des estimations.

L'investissement initial peut également être un frein. Le temps passé à optimiser un algorithme ou à mettre en place une observabilité énergétique complète est du temps qui n'est pas consacré au développement de nouvelles fonctionnalités. Il s'agit donc de trouver le bon équilibre et de cibler les "quick wins" : les zones de l'application les plus gourmandes en ressources.

Enfin, il existe un risque de "greenwashing", où l'on se concentre sur des optimisations marginales pour l'image, sans s'attaquer aux vrais problèmes d'architecture. Une démarche sincère requiert de la rigueur et une volonté de remettre en question des choix techniques profonds.

Conclusion : Devenir un artisan du logiciel responsable

L'ingénierie logicielle durable nous invite à élargir notre définition d'un logiciel de "qualité". Un code de qualité n'est pas seulement un code qui fonctionne, qui est testable et maintenable c'est aussi un code qui est efficient et respectueux des ressources qu'il consomme. C'est un retour à une forme d'artisanat où l'élégance d'une solution se mesure aussi à sa sobriété.

En tant que future génération d'ingénieurs DevOps, vous avez le pouvoir et la responsabilité d'intégrer cette conscience écologique au cœur de vos pratiques. Commencez petit : mesurez, identifiez le composant le plus gourmand de votre application et optimisez-le. Chaque watt économisé est une victoire. Le futur du logiciel sera performant, résilient, sécurisé, et inévitablement, durable.

Espace commentaire

Écrire un commentaire

Vous devez être connecté pour poster un message !

14 commentaires

La performance logicielle c'est la clé pour réduire l'empreinte.

Les défis et les angles morts sont bien identifiés, c'est une approche réaliste.

Ce guide c'est une feuille de route pour un code plus propre et plus efficace.

On avait des doutes sur l'intégration du FinOps avec le green IT.

ça clarifie bien comment écologie rime avec économie en pratique.

Mettre la mesure carbone dans la CI/CD c'est juste intelligent.

Le green-sizing c'est la nouvelle norme pour notre infra cloud.

Coût énergétique du code, une thématique qu'on doit tous adresser.

Devenir un artisan du logiciel responsable, c'est l'objectif.

Le lien avec le FinOps, ça donne une vraie justification business à l'éco-conception.

L'exemple de "Quality Gate" énergétique avec GitLab CI est super utile.

on utilise gitlab, donc c'est directement applicable pour nous.

Intégrer la mesure carbone dans la pipeline CI/CD, ça c'est concret.

On cherche des métriques pour ça, un quality gate énergétique ce serait génial.

Du "Right-Sizing" au "Green-Sizing", ça change complètement la perspective sur l'infra.

La performance comme premier levier écologique, c'est juste logique en fait. Bien de le rappeler.

Enfin on parle de l'angle mort de notre industrie, le coût énergétique du code. C'est urgent.