L'Observabilité Prédictive : Bienvenue dans l'ère du "corriger avant que ça ne casse"

As-tu déjà ressenti cette montée d'adrénaline à 3 heures du matin, déclenchée par une alerte PagerDuty signalant qu'un service critique est tombé ? Nous sommes tous passés par là. Pendant des années, notre métier a consisté à réagir le plus vite possible. Mais si je te disais que cette époque est en train de se terminer ?

Aujourd'hui, nous ne nous contentons plus de regarder des dashboards qui nous disent ce qui a mal tourné. Nous construisons des systèmes qui nous préviennent de ce qui va mal tourner. C'est le changement de paradigme fondamental apporté par l'Observabilité Prédictive, une discipline qui fusionne l'analyse de données en temps réel avec la puissance de l'intelligence artificielle.

L'objectif n'est plus seulement de réduire le temps moyen de résolution (MTTR), mais de carrément empêcher l'incident de se produire. C'est une véritable révolution dans notre approche de la fiabilité et de la résilience des systèmes distribués.

Des piliers classiques à l'intelligence proactive

Pour bien saisir la portée de cette évolution, il faut d'abord revenir sur les fondations de l'observabilité que tu connais bien. Le fameux triptyque Logs, Métriques et Traces a été notre boussole pendant une décennie pour naviguer dans la complexité de nos applications.

Pourtant, ces piliers ont une limite fondamentale : ils sont réactifs par nature. Ils décrivent un état passé ou présent, mais ne fournissent que très peu d'indices sur le futur. On passe notre temps à chercher une aiguille dans une botte de foin après que l'incendie se soit déclaré.

Quand les données brutes ne suffisent plus

Imagine un cluster Kubernetes avec des centaines de microservices. La quantité de données générées est astronomique. Analyser manuellement les corrélations entre un pic de latence sur le service de paiement, une augmentation des erreurs 503 sur l'API Gateway et une saturation de la mémoire sur un pod spécifique est une tâche herculéenne, voire impossible pour un humain en temps réel.

C'est précisément là que l'approche classique montre ses limites. Nous avons des montagnes de données, mais une capacité limitée à en extraire une sagesse prédictive. L'AIOps (AI for IT Operations) intervient pour combler ce fossé, en agissant comme une couche d'intelligence au-dessus de nos outils de monitoring traditionnels.

Concrètement, l'AIOps va permettre de :

- Détecter des anomalies et des patterns invisibles à l'œil nu.

- Corréler des événements faibles provenant de sources multiples (logs applicatifs, métriques système, traces distribuées).

- Analyser les dépendances entre les services pour comprendre les effets de bord.

- Établir des lignes de base dynamiques (baselines) pour chaque service, qui s'adaptent au cycle de vie de l'application.

Le rôle central des modèles causaux profonds

Le véritable moteur de cette révolution, ce sont les modèles causaux profonds. Contrairement aux modèles de machine learning classiques qui se contentent d'identifier des corrélations ("quand A se produit, B se produit souvent aussi"), les modèles causaux cherchent à comprendre les relations de cause à effet ("A est la cause de B").

Cette distinction est cruciale. En comprenant la causalité, le système peut non seulement prédire une panne imminente mais aussi identifier sa cause racine probable, permettant une intervention ciblée bien avant que l'utilisateur final ne soit impacté.

Ces modèles apprennent en continu à partir du flux de données d'observabilité de ton système, construisant une sorte de "jumeau numérique" du comportement de ton application.

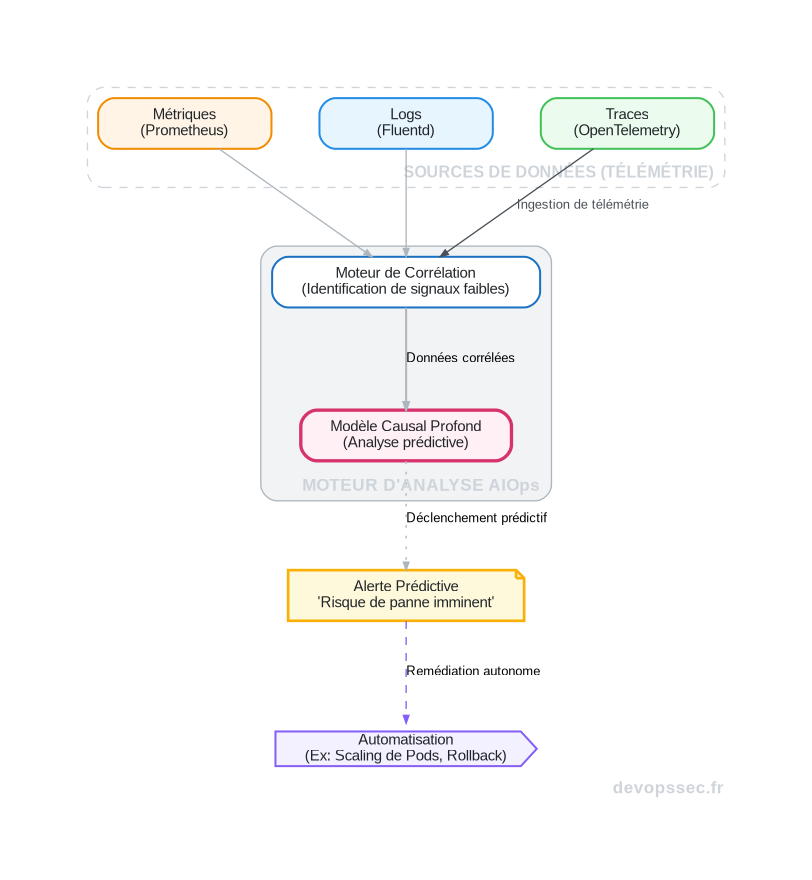

Ce schéma illustre parfaitement le parcours de la donnée. Les sources brutes de télémétrie sont d'abord ingérées et corrélées pour identifier des signaux qui, isolément, seraient insignifiants. C'est ensuite le modèle causal qui analyse ces signaux pour prédire une dégradation future et générer une alerte enrichie, qui peut même déclencher une action de remédiation automatique.

Mise en pratique : Anticiper une saturation de service

La théorie, c'est bien, mais voyons comment cela se matérialise sur le terrain. Imaginons un service de traitement de commandes qui tourne sur Kubernetes. Il a tendance à avoir des fuites de mémoire lentes sous une charge spécifique, menant à un crash du pod après plusieurs heures.

Avec une approche classique, tu recevrais une alerte quand le pod entre en état CrashLoopBackOff. Il est déjà trop tard, des commandes ont été perdues. Avec l'observabilité prédictive, le scénario est tout autre.

La qualité des données est reine

Un modèle prédictif est aussi bon que les données qu'on lui fournit. Avant de penser IA, assure-toi que ton instrumentation (via OpenTelemetry par exemple) est riche et standardisée. Des logs bien structurés en JSON et des traces complètes sont des prérequis non négociables.

La plateforme AIOps, qui observe continuellement les métriques de Prometheus, va détecter une corrélation subtile qu'un humain raterait. Elle remarque qu'une légère augmentation de la latence sur une route d'API spécifique est systématiquement suivie, 90 minutes plus tard, par une augmentation linéaire de l'utilisation de la mémoire du pod correspondant.

L'outil ne se contente pas de voir la montée de la RAM. Il a identifié le symptôme précurseur. Au lieu d'une alerte brute, il génère un rapport prédictif.

ops-ai-cli predict --service order-processor --namespace productionRésultat:

[PREDICTIVE ALERT - SEVERITY: HIGH]

Service: order-processor-7c6f8d...

Anomalie Détectée: Corrélation anormale entre la latence de la route /api/v2/order/validate et la consommation mémoire.

Prédiction: Crash du pod par OOMKilled probable dans ~75 minutes avec un niveau de confiance de 92%.

Cause Racine Suggérée: Fuite mémoire probable dans le `OrderValidatorService`.

Action Recommandée: Déclencher un redémarrage progressif du pod de manière préventive pour éviter une interruption de service.Tu vois la différence ? L'alerte n'est plus un simple "ça a cassé", mais un véritable plan d'action qui t'informe du quoi, du pourquoi et du comment agir, bien avant l'impact.

Les défis de l'intelligence artificielle en production

Bien que prometteuse, cette technologie n'est pas une solution miracle. L'adopter aveuglément sans comprendre ses contraintes mène souvent à la désillusion. Il est essentiel de garder un esprit critique et de comprendre les investissements nécessaires.

| Avantages Stratégiques | Coûts et Risques Associés |

|---|---|

| Réduction drastique du nombre d'incidents critiques. | Coût élevé des plateformes AIOps (licences et infrastructure). |

| Amélioration de la résilience opérationnelle et du SLO. | Nécessite des données de télémétrie de très haute qualité (coût d'instrumentation). |

| Libère du temps pour les équipes SRE qui passent moins de temps en astreinte. | Risque de "fatigue des alertes" due aux faux positifs si le modèle est mal entraîné. |

| Aide à l'identification de la dette technique et des bugs de performance. | Compétences pointues nécessaires en interne (Data Science, MLOps) pour maintenir et affiner les modèles. |

Le plus grand défi est souvent culturel. Les équipes doivent apprendre à faire confiance aux prédictions de la machine, tout en restant capables de les challenger. Cela demande de développer une nouvelle compétence : celle d'interpréter et de valider les recommandations de l'IA.

Conclusion : Vers des opérations autonomes

L'observabilité prédictive n'est pas une simple évolution, c'est une refonte de notre philosophie de la production. Nous passons d'un rôle de "pompiers" du numérique à celui "d'architectes" de systèmes résilients, capables de s'auto-diagnostiquer et, à terme, de s'auto-réparer.

Le chemin est encore long, et l'adoption de ces outils demande de la rigueur et un investissement significatif. Mais le gain est immense : des systèmes plus fiables, des nuits plus calmes et des ingénieurs focalisés sur la création de valeur plutôt que sur la gestion de crises. Prépare-toi, car le futur des opérations est déjà là, et il est prédictif.

Espace commentaire

Écrire un commentaire

Vous devez être connecté pour poster un message !

16 commentaires

Excellente lecture pour comprendre la transition vers l'observabilité prédictive

Le futur du DevOps est bien là avec cette capacité à corriger avant que ça ne casse

C'est la promesse de réduire drastiquement les incidents et d'améliorer notre SLO

Les piliers classiques à l'intelligence proactive c'est la bonne évolution

Fini le monitoring passif on passe à l'action anticipée

Ce focus sur l'optimisation de la résilience des applications via l'IA

on est trop souvent en mode réactif là ça ouvre de nouvelles perspectives pour une infra vraiment solide

Vraiment hâte de voir comment l'IA peut anticiper les pannes avant l'impact utilisateur

Ça va nous sauver des nuits blanches c'est sûr

L'observabilité prédictive c'est ce qu'on attendait tous

Plus besoin de se battre pour comprendre pourquoi le service a cassé, on pourra agir avant

Merci d'avoir souligné l'importance des modèles causaux profonds

Ça montre qu'on dépasse la simple corrélation pour vraiment comprendre les root causes c'est une avancée majeure

Bien vu les défis de l'IA en production c'est pas encore plug and play

La prediction causale c'est le game changer pour l'uptime de nos services

Le constat que les données brutes ne suffisent plus est tellement vrai

Top la vision de l'intelligence proactive ça change tout

les opérations autonomes c'est la suite logique pour le devops on y arrive

Le cas d'usage sur l'anticipation d'une saturation de service est super concret merci

Enfin on parle de transformer l'observabilité en un système prédictif

les modèles causaux profonds c la clé pour sortir des dashboards réactifs

L'idée de corriger avant que ça ne casse c juste le rêve