Avez-vous déjà passé des heures à chercher l'erreur d'indentation fatale dans une configuration interminable ?

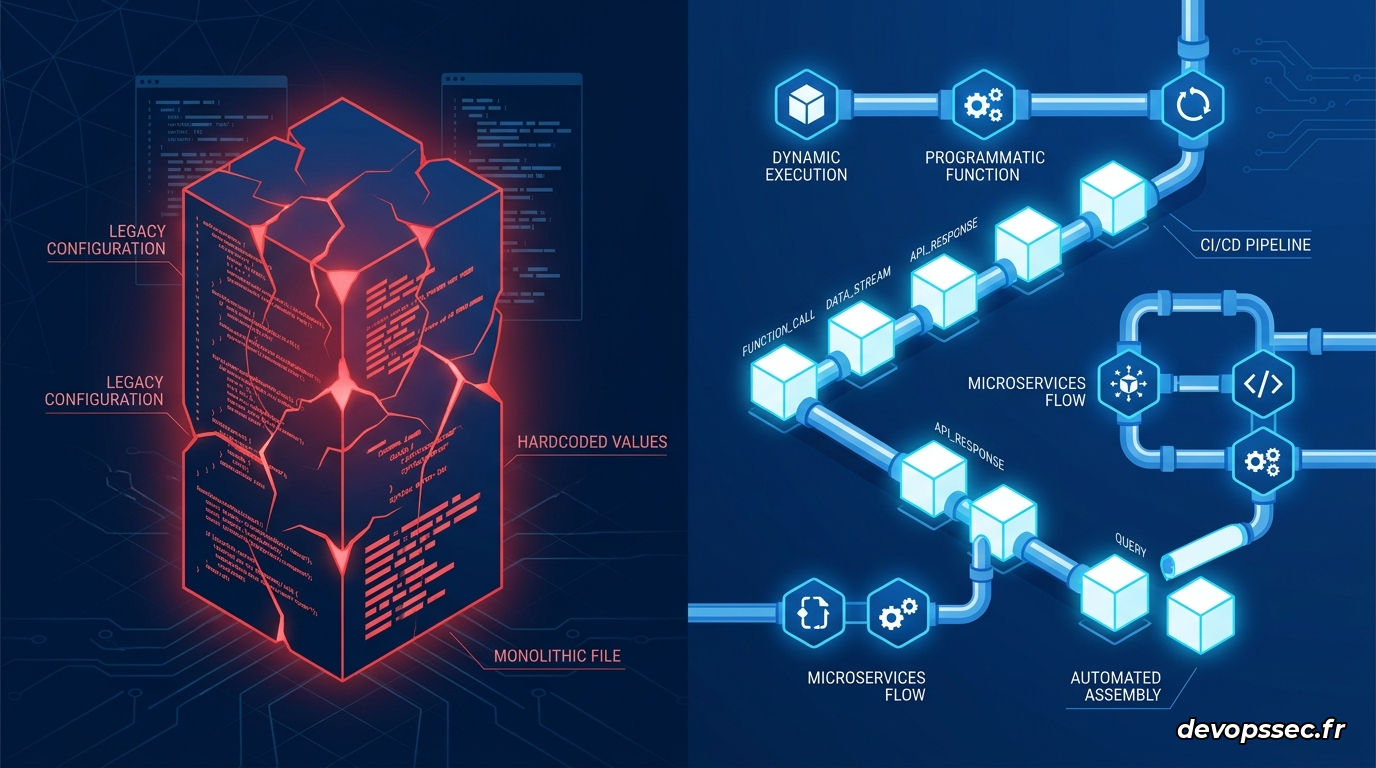

L'ingénierie moderne exige de l'agilité, pourtant nos processus de livraison logicielle reposent encore massivement sur des langages de balisage qui n'ont jamais été conçus pour abriter de la logique complexe. Face à l'évolution des architectures distribuées, l'approche traditionnelle par fichiers statiques montre rapidement ses limites, rendant les chaînes de compilation fragiles, difficiles à tester localement et pratiquement impossibles à factoriser correctement. C'est précisément dans cette zone de friction que se cristallise le besoin fondamental de repenser notre manière de concevoir l'Intégration et Déploiement Continus (CI/CD), un concept clé qui désigne l'automatisation rigoureuse des tests et de la mise en production des applications.

Dans ce contexte de modernisation, nous allons explorer une méthode radicalement différente en nous appuyant sur des outils pensés pour les développeurs. Nous quitterons le monde purement déclaratif pour entrer dans une dimension où la logique de livraison est exprimée dans des langages complets et sécurisés. D'un côté, nous utiliserons Dagger pour orchestrer l'exécution de nos tâches sous forme de code pur, et de l'autre, nous intégrerons CUE pour garantir l'intégrité de nos modèles de données avant même leur exécution.

Dagger, le moteur d'exécution qui libère la logique de vos builds

La transition vers des Pipelines as Code représente un changement de paradigme majeur dans la culture de l'automatisation. Plutôt que de confier l'exécution de nos scripts à un orchestrateur distant opaque, Dagger nous permet d'encapsuler toute la complexité du processus de livraison dans des fonctions exécutables localement, exactement de la même manière que nous écririons le code métier de notre application logicielle.

Repenser l'approche par l'automatisation programmatique

Historiquement, tester une chaîne de déploiement impliquait de pousser un commit d'essai, d'attendre que la plateforme distante prenne en charge la tâche, puis d'espérer que les logs nous donnent une piste exploitable en cas de crash. Avec Dagger, cette boucle de rétroaction infiniment lente disparaît totalement, car le moteur d'exécution repose intégralement sur la Conteneurisation, permettant à chaque étape du pipeline de s'isoler et de s'exécuter dans un environnement reproductible directement sur la machine du développeur.

Concrètement, le concept repose sur la création de graphes d'exécution dynamiques construits à la volée. Lorsque vous lancez une commande avec la classe dagger run, le moteur intercepte vos appels de fonctions, analyse les dépendances entre les différentes étapes, et orchestre le tout de manière hautement parallélisée. Par conséquent, non seulement vous bénéficiez de l'autocomplétion et du typage statique offerts par votre langage de programmation favori, mais vous profitez également d'une mise en cache intelligente qui accélère drastiquement les itérations suivantes.

Pour vous donner une idée plus précise de la puissance de cet outil, observons comment une simple tâche de compilation peut être déclarée en Go, puis exécutée sans avoir besoin de paramétrer le moindre agent externe. Vous remarquerez que la syntaxe s'affranchit des contraintes habituelles des serveurs d'intégration pour se concentrer uniquement sur la logique d'assemblage des conteneurs éphémères.

Prérequis d'exécution Dagger

Pour que la magie opère en local, vous devez impérativement avoir un démon Docker actif sur votre machine. Dagger va automatiquement télécharger son propre moteur d'exécution sous forme de conteneur, créant ainsi une couche d'abstraction parfaite entre votre système hôte et l'environnement de build.

Examinons maintenant une exécution réelle dans le terminal, illustrant la rapidité et la clarté des retours fournis par le moteur local.

dagger run go run ci/main.goRésultat:

✔ resolve image golang:alpine 0.4s

✔ exec go build -o myapp 1.2s

✔ export directory ./dist 0.1s

Pipeline terminé avec succès.CUE, le gardien du temple de vos définitions de données

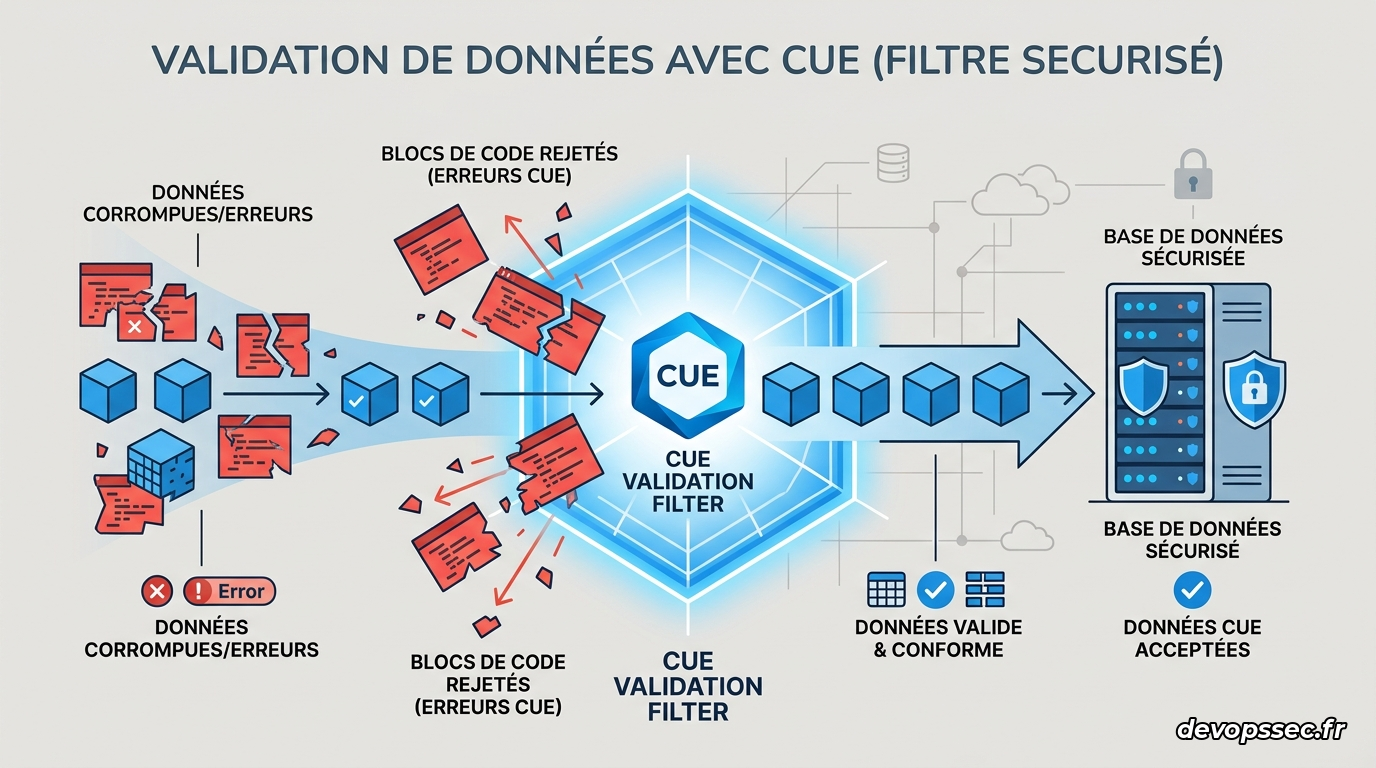

Si Dagger résout magistralement le problème de l'exécution, il reste souvent un défi de taille concernant la définition et la structure des paramètres injectés dans nos chaînes de livraison. C'est ici que le langage CUE entre en scène pour assurer la Validation des configurations, un processus indispensable pour s'assurer que les valeurs fournies à notre infrastructure respectent un schéma strict et préétabli avant même de lancer le moindre traitement lourd.

Valider les variables plutôt que subir les erreurs en production

Contrairement aux langages classiques qui séparent la définition des types et la déclaration des valeurs, CUE fusionne ces deux concepts de manière élégante. Dans l'écosystème CUE, un type n'est rien d'autre qu'une valeur partielle, ce qui permet de définir des contraintes extrêmement granulaires. Par exemple, vous pouvez exiger qu'une variable réseau soit non seulement de type chaîne de caractères, mais qu'elle respecte également un format d'adresse IP valide, prévenant ainsi une panne fatale lors du déploiement sur les grappes de serveurs.

Cette approche unifiée élimine le besoin d'écrire de longs scripts de vérification en bash ou en Python. En définissant vos schémas dans un répertoire dédié, souvent structuré sous un chemin comme /infra/schemas/, vous centralisez la vérité absolue de ce qui est autorisé ou interdit dans votre architecture. Dès lors, le couplage entre la rigueur de CUE et la flexibilité de Dagger crée un écosystème où l'erreur humaine est détectée de manière anticipée et explicite.

Pour illustrer la syntaxe de validation, analysons un bloc de code CUE qui définit les règles strictes d'un déploiement applicatif. La force de cet outil réside dans sa capacité à évaluer l'ensemble des règles de manière commutative, assurant que l'ordre des déclarations n'impacte jamais le résultat final de la validation.

#Deployment: {

name: string

replicas: int | *3 & >=1 & <=10

image: string & =~"^registry.example.com/"

env: [string]: string

}

myApp: #Deployment & {

name: "api-backend"

image: "registry.example.com/api:v2"

env: {

PORT: "8080"

}

}Afin de mieux cerner la supériorité de ce langage spécifique dans le cadre de l'ingénierie système, il est pertinent d'observer un comparatif direct avec les formats de sérialisation traditionnels que vous avez l'habitude de manipuler dans vos projets quotidiens.

| Caractéristique | YAML | JSON Schema | CUE |

|---|---|---|---|

| Typage et contraintes | Inexistant nativement | Verbeux et complexe | Intégré et déclaratif |

| Héritage et fusion | Basique via ancres | Limité | Algorithme de subsomption natif |

| Lisibilité humaine | Bonne mais trompeuse (indentation) | Médiocre pour l'humain | Excellente, syntaxe proche du Go |

L'envers du décor et la réalité opérationnelle

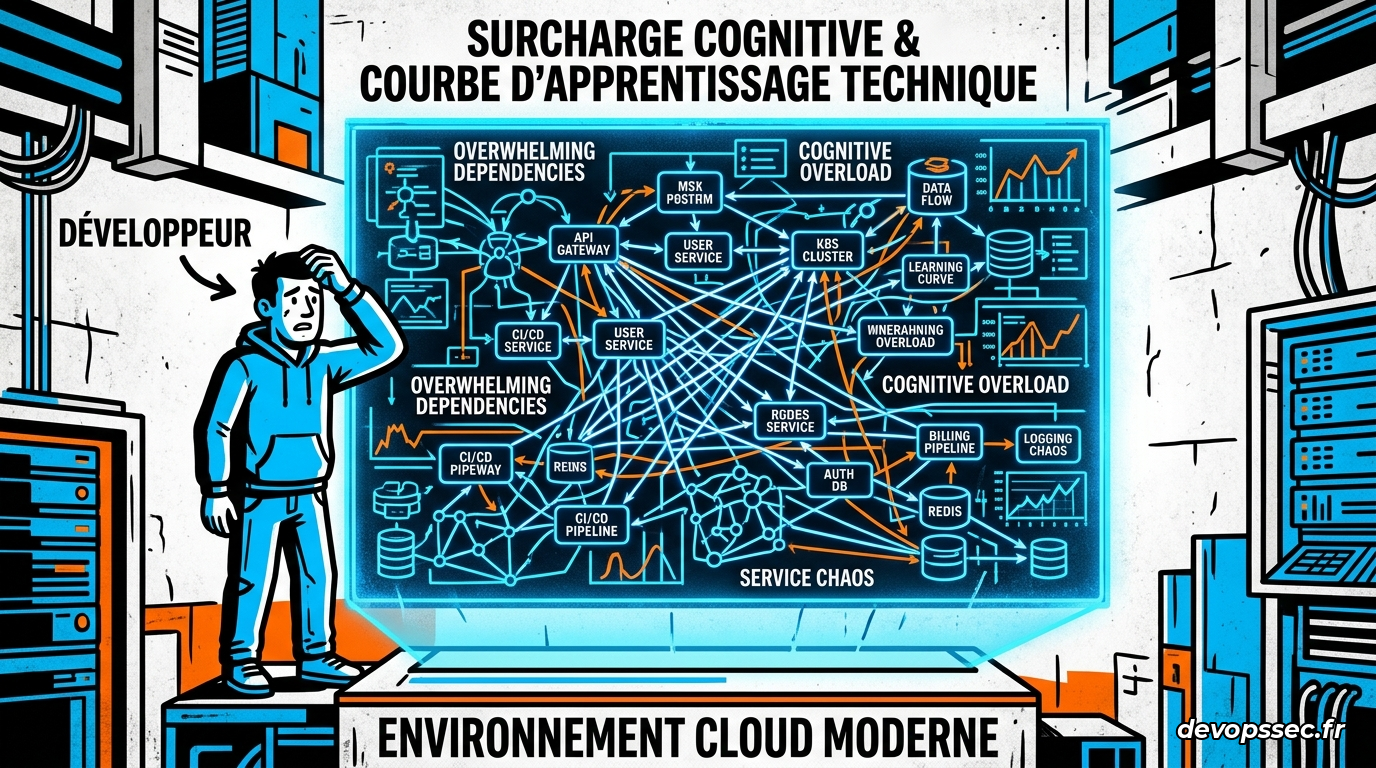

Même si la promesse d'une automatisation robuste et validée mathématiquement semble irrésistible, il est de mon devoir de mentor de vous alerter sur les défis pratiques qu'implique l'adoption de ces technologies modernes. L'ingénierie est avant tout une affaire de compromis, et remplacer un écosystème établi par des outils de pointe exige de la clairvoyance face aux potentiels obstacles techniques que vous rencontrerez sur le terrain.

Gérer la dette cognitive et les risques d'architecture

Le premier frein majeur réside indéniablement dans la courbe d'apprentissage. Demander à une équipe opérationnelle de maîtriser un langage de programmation complet pour écrire un pipeline, couplé à un langage de logique formelle comme CUE pour les données, représente un effort cognitif colossal. Il ne s'agit plus simplement d'apprendre quelques balises déclaratives, mais de comprendre de véritables paradigmes de développement logiciel incluant la gestion des pointeurs, les interfaces et la conception orientée objet.

De plus, l'utilisation de Dagger introduit une dépendance forte au moteur d'exécution local. Bien que l'outil excelle dans la reproductibilité, il ajoute une couche d'abstraction supplémentaire qui peut s'avérer complexe à débugger lorsque les erreurs proviennent des couches basses du système réseau ou du démon de conteneurisation lui-même. En matière d'Observabilité, extraire et interpréter les métriques d'une exécution nichée dans des graphes dynamiques requiert la mise en place de sondes spécifiques et d'outils de traçabilité avancés.

Il est donc crucial de peser les pour et les contre avant de refondre l'intégralité de votre chaîne d'intégration. Pour vous aider à structurer votre réflexion, voici les principales limites structurelles que vous devrez surveiller attentivement si vous décidez d'entreprendre cette migration technique.

- Le coût initial de réécriture de vos processus historiques vers une syntaxe programmatique exigera un investissement en temps substantiel.

- La complexité de l'intégration continue locale peut saturer les ressources matérielles des machines de développement moins performantes.

- Le risque de créer des usines à gaz algorithmiques pour des tâches de déploiement qui auraient pu rester triviales et séquentielles.

- L'absence de standards unifiés autour de CUE sur le marché du travail, nécessitant des efforts de formation interne continus pour l'intégration des nouveaux collaborateurs juniors.

Conclusion et perspectives vers l'autonomie technique

Nous venons de parcourir une approche audacieuse qui repousse les limites des configurations figées pour embrasser la pleine puissance du développement logiciel au service des infrastructures. En combinant la programmabilité fluide de Dagger et la rigueur implacable de CUE, vous disposez désormais d'un arsenal conceptuel capable de transformer la livraison continue en une discipline hautement prédictive et ingénierique.

N'oubliez jamais que l'objectif ultime n'est pas de complexifier votre quotidien avec des outils à la mode, mais de reprendre le contrôle absolu sur la fiabilité de vos déploiements. En tant que jeune ingénieur technique, maîtriser l'art d'encoder la logique opérationnelle tout en validant structurellement ses données d'entrée vous placera à l'avant-garde d'une industrie qui ne pardonne plus les régressions accidentelles. Testez ces approches sur des projets isolés, appropriez-vous les erreurs de compilation, et bâtissez progressivement les fondations d'une automatisation véritablement résiliente.

Espace commentaire

Écrire un commentaire

Vous devez être connecté pour poster un message !

15 commentaires

actif

Enfin quelqu'un qui dit ça. Les pipelines YAML sont le cauchemar de l'indenter. On passe 50% du temps sur le YAML et 50% à chercher où le `indentation_error` se cache. Nightmare.

actif

Dagger est une grosse amélioration pour l'expérience dév. En général, le fait de pouvoir utiliser l'autocomplétion et le typage statique en local, c'est un gain de temps massif par rapport à `docker build` classique.

Ça force une approche plus 'programmatic' du devops, ce qui est sain.

actif

le passage du déclaratif au *programmatic* pour le ci/cd, c'est le vrai changement de paradigme. c'est difficile à vendre au boss qui aime encore les diagrams et les fichiers statiques.

Mais franchement, l'idée de graphes d'exécution dynamiques construites à la volée, c exactement ce qu'il faut pour des micro-services avec des dépendances non-linéaires.

actif

cue pour la validité des modèles de données, c'est ultra puissant. on utilisait juste des validations schéma json/yaml super lourdes avant.

avec cue, on garantit l'intégrité du *metadata* (ex: les versions des dépendances) au niveau de la construction même. c'est au niveau dev.ops de vraiment embrasser ça.

actif

J'aime beaucoup la mise en avant de l'environnement reproductible localement. Finir un devop en `docker compose` sur son machine, puis de se rendre compte que le CIRunner est basé sur `manjaro` et que ça plante à cause d'une librairie man واحدة, c'est le pire.

actif

Ce qu'on veut, ce n'est pas juste de l'automatisation, on veut la *predictability*. Et la conteneurisation est le seul moyen de garantir ça, même si ça complique l'adoption pour les équipes moins habituées.

actif

Dagger résout un problème archaïque : la divergence entre l'environnement local du dev et le runner CI. Le *local development loop* est essentiel.

je soupçonne que la gestion du cache avec dagger est la killer feature pour les grands monorepos. moins de re-build, c'est de l'argent.

actif

L'utilisation de Dagger en Go pour la compilation est un excellent exemple. Ça montre que l'orchestrateur n'est plus un 'service magique', mais juste une couche de code de plus. c un peu *boring*, mais vital.

actif

Je ne suis pas sûr que CUE doive être couplé à Dagger pour tout, mais le principe de validation des configurations *avant* le build est top. Ça te coûte moins cher en temps de debugging que de laisser le pipeline crasher après 3 étapes.

actif

On a dû switcher de Jenkinsfiles classiques à un modèle plus de fonctionnel. La courbe d'apprentissage est raide, mais la robustesse quand ça tourne est imbattable. Ça vaut le coup.

actif

Le fait que Dagger gère l'analyse des dépendances et l'orchestration hautement parallélisée, c'est le nerf de la guerre dans les grands monorepos. On gagne un temps fou comparé à des build séquentiels.

actif

Question pointue sur Dagger : quand on passe des pipelines statiques à des graphes dynamiques construits à la volée, est-ce qu'il y a un risque de complexité cachée dans la gestion des *sidecar containers* ? Il faut bien pouvoir debugger l'état de ces services externes.

actif

J'aimerais voir un cas d'usage plus concret avec CUE pour la gestion des variables d'environnement sensibles. On utilise des fichiers de configuration qui changent de structure à chaque micro-service. CUE pourrait vraiment forcer l'uniformité.

actif

Franchement, la 'boîte noire' de certains orchestrateurs traditionnels, ça m'a toujours énervé. Être capable d'encapsuler tout dans une fonction exécutable et de voir le *runtime* ça change la donne.

actif

Le côté 'Pipelines as Code' doit être une obligation pour la conformité (auditabilité). Si ça n'est pas dans le code versionné, ça n'existe pas, point final.