Et si votre posture de sécurité pouvait prédire l'avenir au lieu de simplement réagir au passé ?

Nous vivons une époque où les alertes de sécurité pleuvent comme une averse tropicale, noyant les équipes sous un flot constant de faux positifs et de menaces de faible priorité. Cette surcharge informationnelle paralyse notre capacité à distinguer le signal du bruit, nous laissant vulnérables aux attaques réellement sophistiquées qui se cachent dans cette cacophonie.

Le modèle traditionnel, où nous scannons, patchons et réagissons, est devenu obsolète. Face à des infrastructures éphémères et des déploiements continus, la sécurité ne peut plus être une simple case à cocher à la fin du cycle. Il est temps de changer de paradigme et d'adopter une approche proactive et prédictive, et c'est précisément là que l'intelligence artificielle entre en jeu.

Imaginez un instant un système qui non seulement détecte une vulnérabilité, mais évalue aussi son contexte, calcule son chemin d'exploitabilité probable dans votre infrastructure spécifique, et propose une remédiation automatisée avant même qu'un acteur malveillant ne puisse l'envisager. C'est la promesse d'une posture de sécurité réinventée.

Comprendre la Posture de Sécurité Dynamique

Avant de plonger dans l'IA, clarifions ce qu'est une "posture de sécurité". Oubliez l'image d'un audit annuel qui produit un rapport poussiéreux. Pensez plutôt à un bilan de santé en temps réel et continu de l'ensemble de vos actifs numériques : code, infrastructure, configurations, identités et données.

Une posture statique vous dit "tu avais une porte ouverte hier". Une posture dynamique, elle, vous alerte en criant "attention, la serrure de cette porte est en train de rouiller et les prévisions météo annoncent une tempête". La différence est fondamentale, car elle nous fait passer de la remédiation à l'anticipation.

Les fondations d'une gestion intelligente des vulnérabilités

L'intégration de l'intelligence artificielle transforme cette surveillance en une véritable tour de contrôle prédictive. Elle ne se contente plus de cataloguer les failles connues (les fameuses CVE), mais analyse des signaux faibles pour en déduire des scénarios de risque futurs. Ce changement repose sur une nouvelle vision de la Posture de Sécurité Continue (CSPM), augmentée par des capacités cognitives.

Concrètement, l'IA ne se contente pas de voir une simple vulnérabilité dans une librairie. Elle la contextualise en se posant les bonnes questions : cette librairie est-elle réellement utilisée par une fonction exposée sur Internet ? Est-ce qu'un chemin d'attaque direct existe depuis le réseau public jusqu'à ce composant précis ? Est-ce que des identités avec des privilèges excessifs pourraient interagir avec lui ?

Cette approche intelligente repose sur plusieurs piliers fondamentaux qui travaillent de concert.

- Analyse prédictive des menaces : L'IA modélise les tactiques, techniques et procédures (TTPs) des attaquants pour prédire les prochains vecteurs d'attaque probables contre votre infrastructure.

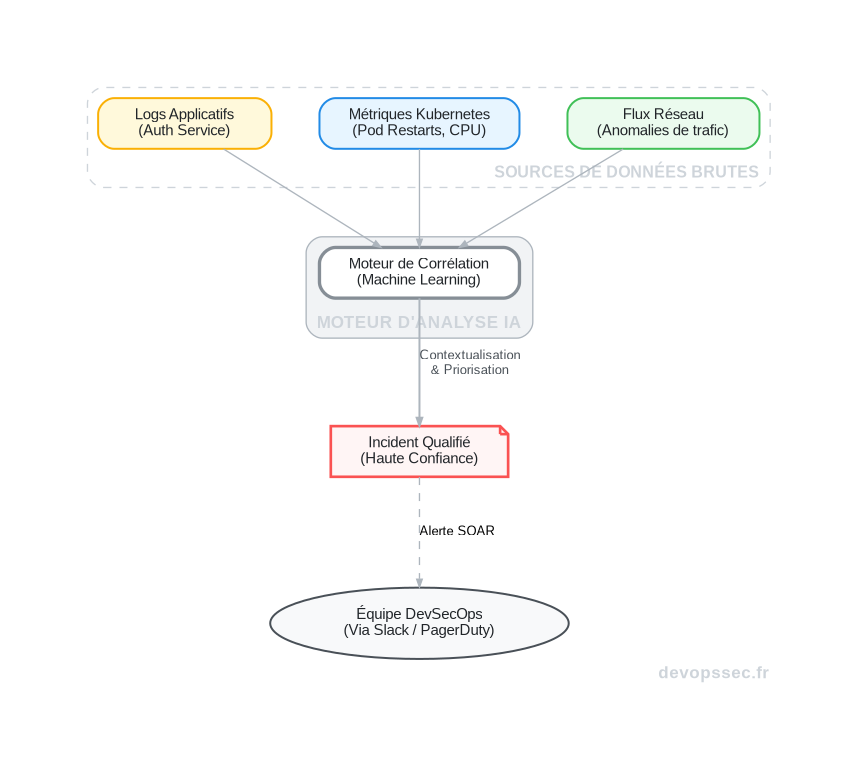

- Corrélation contextuelle des événements : Elle fusionne des signaux provenant de sources hétérogènes (logs, métriques, flux réseau) pour construire une vue d'ensemble cohérente d'un incident, réduisant drastiquement le bruit.

- Automatisation de la remédiation : Sur la base de sa compréhension du risque, l'IA peut déclencher des workflows de remédiation automatisés, comme l'isolation d'un conteneur ou la révocation d'une clé d'API compromise.

Le piège des faux positifs et la fatigue des alertes

L'un des plus grands fléaux du DevSecOps moderne est la fatigue liée aux alertes. Les outils traditionnels, par leur manque de contexte, génèrent un volume d'informations tel que les équipes finissent par ignorer les notifications, passant à côté des menaces critiques. C'est un peu comme une alarme de voiture qui se déclenche à chaque fois qu'un chat passe à proximité : on finit par ne plus y prêter attention.

L'IA agit comme un filtre intelligent. En comprenant ce qui est "normal" pour votre application et votre infrastructure (ce qu'on appelle le "baseline behavior"), elle est capable de distinguer une anomalie véritablement suspecte d'une simple fluctuation opérationnelle. C'est la fin du "syndrome de Pierre et le loup" pour vos ingénieurs de garde.

L'importance du jeu de données

La performance d'un modèle d'IA dépend entièrement de la qualité et de la quantité des données sur lesquelles il a été entraîné. Une solution IA alimentée avec des logs incomplets ou des métriques bruitées produira des résultats médiocres. La première étape est donc toujours d'assurer une observabilité robuste de vos systèmes.

L'IA en Pratique : de la Théorie à la Pipeline CI/CD

Assez de théorie, voyons comment cette intelligence s'applique concrètement dans notre quotidien de DevOps. L'IA ne se contente pas d'analyser ce qui tourne en production, elle intervient bien plus tôt, dès la phase de développement, pour sécuriser la chaîne d'approvisionnement logicielle.

Analyse prédictive dans votre workflow de déploiement

Imaginez un "linter" de sécurité surpuissant intégré directement dans votre pipeline CI/CD. Au moment où un développeur soumet une "Merge Request", l'IA n'analyse pas seulement le code à la recherche de vulnérabilités connues, mais elle examine aussi les changements d'infrastructure-as-code (IaC), les dépendances et les configurations pour y déceler des risques potentiels.

C'est le cœur de l'Analyse de la Chaîne d'Approvisionnement Logicielle moderne. L'IA peut, par exemple, détecter qu'une nouvelle dépendance open-source, bien que n'ayant aucune CVE officielle, provient d'un mainteneur peu fiable ou présente un comportement suspect dans son code. Elle va au-delà du simple scan de versions.

Prenons un exemple simple dans un fichier de configuration pour un orchestrateur de conteneurs.

apiVersion: v1

kind: Pod

metadata:

name: pod-avec-token-service-account

spec:

containers:

- name: mon-app

image: nginx

# L'IA détecterait que le montage automatique du token est une mauvaise pratique

# si le pod n'a pas besoin de communiquer avec l'API Kubernetes.

automountServiceAccountToken: trueUn outil classique se contenterait de valider la syntaxe YAML. Un moteur IA, lui, comprendrait le contexte et signalerait que monter automatiquement un token de service pour un simple pod Nginx est une surface d'attaque inutile, même si ce n'est pas une "vulnérabilité" au sens strict du terme.

Corréler les signaux faibles pour révéler les menaces complexes

Le véritable super-pouvoir de l'IA réside dans sa capacité à connecter des points qui semblent n'avoir aucun lien pour un humain. C'est le principe derrière les plateformes de eXtended Detection and Response (XDR) qui utilisent le Machine Learning pour transformer le chaos en clarté.

Un pic de latence sur une API, une augmentation des erreurs 404 dans les logs d'un reverse proxy, et un pod qui redémarre en boucle sur votre cluster Kubernetes. Pris séparément, ces événements sont des incidents opérationnels mineurs. Mais une IA pourrait les corréler et en déduire qu'il s'agit d'une tentative de "credential stuffing" qui cause le crash de votre service d'authentification.

Ce schéma illustre parfaitement le processus. Des milliers d'événements bruts et bruyants entrent dans le moteur d'analyse. Celui-ci, grâce à ses modèles, ne laisse sortir qu'un petit nombre d'incidents qualifiés, contextualisés et exploitables, qui sont directement transmis à l'équipe via des outils d'automatisation (SOAR - Security Orchestration, Automation and Response).

Intégrer l'IA dans votre Stack : Stratégies et Outils

L'adoption de l'IA en sécurité n'est pas un projet "big bang". Elle doit se faire de manière progressive et réfléchie, en commençant par identifier les domaines où elle apportera le plus de valeur ajoutée pour soulager vos équipes.

Choisir la bonne approche pour votre maturité

Le marché regorge d'outils se revendiquant "AI-powered". Pour s'y retrouver, il est crucial de comprendre les différentes catégories et leurs cas d'usage principaux. Il n'existe pas de solution miracle, le choix dépendra de votre stack technique et de vos points de douleur actuels.

| Type d'Outil | Cas d'Usage Principal | Point de Vigilance |

|---|---|---|

| SAST / DAST Augmenté à l'IA | Analyse de code et de dépendances en CI/CD avec réduction des faux positifs. | Nécessite une intégration profonde dans les outils de développement. |

| Plateforme de Threat Intelligence IA | Analyse prédictive des menaces externes et corrélation avec les vulnérabilités internes. | Peut être coûteux et nécessite une expertise pour interpréter les résultats. |

| SIEM / XDR de Nouvelle Génération | Détection d'anomalies comportementales sur l'infrastructure en production. | Génère des volumes de données importants, attention aux coûts de stockage et de traitement. |

| Copilotes de Sécurité (LLM) | Assistance à l'investigation et à la remédiation en langage naturel. | Risque de "hallucinations" du modèle, les réponses doivent être vérifiées par un humain. |

Le dialogue avec un "Security Copilot"

L'une des avancées les plus spectaculaires est l'arrivée des assistants basés sur des modèles de langage (LLM) spécialisés en cybersécurité. Fini le temps où il fallait maîtriser des dizaines de requêtes complexes pour investiguer un incident. Aujourd'hui, on peut littéralement discuter avec son système de sécurité.

Imaginez qu'une alerte de type "Accès suspect depuis une nouvelle IP" soit remontée. Votre premier réflexe ne sera plus de fouiller dans les logs, mais de poser une question simple à votre copilote.

Montre-moi toutes les actions effectuées par l'utilisateur 'admin-ci' depuis l'adresse IP 81.92.114.32 au cours des 6 dernières heures sur le cluster de production. Exclus les actions en lecture seule.Réponse du Copilote IA:

Bien sûr. Voici les actions à risque effectuées par 'admin-ci' depuis 81.92.114.32 :

- [14:32:11 UTC] Création du secret Kubernetes 'db-credentials-backup'.

- [14:34:02 UTC] Exécution d'une commande shell dans le pod 'payment-gateway-7f...'.

- [14:37:51 UTC] Mise à jour du rôle de cluster 'cluster-admin' pour ajouter un nouveau 'ServiceAccount'.

ANALYSE DE RISQUE : L'IP 81.92.114.32 est associée à un nœud de sortie Tor connu. Les actions effectuées sont hautement suspectes et indiquent une potentielle compromission du compte de service.

RECOMMANDATION : Je recommande de révoquer immédiatement les accès de 'admin-ci' et de lancer le playbook de réponse à incident 'Compromission de Compte à Privilèges'. Voulez-vous que je le fasse ?Cette interaction change la donne. Elle réduit le temps moyen de détection et de réponse (MTTD/MTTR) de plusieurs heures à quelques minutes, démocratisant l'expertise en sécurité pour l'ensemble des équipes DevOps.

Conclusion : Vers une Culture DevSecOps Augmentée

L'intelligence artificielle n'est pas une baguette magique qui fera disparaître tous les risques de sécurité. Elle ne remplace pas, et ne remplacera jamais, l'intuition, l'expérience et l'éthique d'un ingénieur sécurité humain. Cependant, elle constitue le plus puissant des multiplicateurs de force que nous ayons jamais eu.

En automatisant les tâches fastidieuses, en réduisant le bruit et en fournissant un contexte prédictif, l'IA libère les experts humains pour qu'ils se concentrent sur ce qu'ils font le mieux : la stratégie, l'architecture sécurisée et la réponse aux incidents complexes. Elle nous permet de passer d'une posture de défense réactive à une posture de résilience proactive.

Pour toi, qui débutes dans cet univers, c'est une opportunité fantastique. Maîtriser ces outils te permettra non seulement de rester pertinent sur le marché du travail, mais surtout de construire des systèmes plus sûrs, plus robustes et plus innovants. Le futur du DevSecOps n'est pas une bataille entre l'homme et la machine, mais une collaboration augmentée.

Espace commentaire

Écrire un commentaire

Vous devez être connecté pour poster un message !

16 commentaires

Super article ça donne envie d'explorer l'IA pour la gestion des vulnérabilités

Le dialogue avec un Security Copilot

C'est une approche intéressante pour augmenter les capacités des équipes sans les remplacer

L'IA en pratique de la théorie à la pipeline CI/CD c'est le passage le plus important

Montrer comment l'implémenter concrètement dans nos workflows c'est ce qui nous aide le plus

Ce que j'aime c'est de voir l'IA transformer la gestion de la posture de sécurité

On a besoin d'outils qui évoluent avec la menace et l'IA semble être la réponse

Intégrer l'IA dans la stack pour de la sécurité prédictive

Ça nous permettrait de passer d'un modèle de détection réactif à un modèle de prévention proactif

Le piège des faux positifs et la fatigue des alertes c'est un problème quotidien

Si l'IA peut nous aider à trier et à nous concentrer sur les vraies menaces ce serait énorme

Le focus sur la résilience inégalée dans le Cloud Native c'est un gros plus

Nos environnements hybrides sont des cibles complexes et l'IA peut vraiment aider

anticiper et corriger proactivement les vulnérabilités c'est le rêve de tous les secops

Gérer la posture de sécurité dynamique avec l'IA c'est super pertinent

la culture devsecops augmentée c la prochaine étape logique

Un Security Copilot ça sonne bien pour augmenter nos capacités

corréler les signaux faibles pour les menaces complexes ça c'est fort

L'analyse prédictive dans le workflow de déploiement c'est une super idée

Fini la fatigue des alertes et le piège des faux positifs j'espère

La gestion intelligente des vulnérabilités c'est ce qu'il nous faut

Prédire l'avenir au lieu de réagir au passé enfin