Au-delà de la page web, une révolution silencieuse

Et si le code de votre prochain microservice ne tournait pas dans un conteneur Docker, mais dans le même moteur d'exécution sécurisé qui fait fonctionner les applications dans votre navigateur ? Cette idée, qui semblait futuriste il y a quelques années, est aujourd'hui une réalité tangible qui bouscule le monde du Cloud Native et de l'Edge Computing.

Cette technologie, c'est WebAssembly (Wasm). Oubliez son nom un instant. Ce n'est plus seulement une affaire de "Web". Il s'agit d'un format binaire universel, une sorte de bytecode portable et ultra-performant qui promet de redéfinir la manière dont nous concevons, déployons et exécutons nos applications, bien loin du navigateur.

Ensemble, nous allons explorer comment ce standard discret est en train de devenir un pilier de l'infrastructure de demain, offrant une alternative légère et sécurisée aux conteneurs traditionnels pour de très nombreux cas d'usage.

WebAssembly : Le Binaire Universel pour le Cloud Native

Qu'est-ce que Wasm, concrètement ?

Imaginez WebAssembly comme une cible de compilation. Au lieu de compiler votre code source (écrit en Rust, Go, C++, etc.) en un binaire spécifique à une architecture de processeur (x86, ARM), vous le compilez en un fichier .wasm. Ce fichier contient des instructions optimisées qui ne sont pas pour un processeur physique, mais pour une machine virtuelle très simple et rapide.

Cette machine virtuelle, ou "runtime" Wasm, peut ensuite être intégrée n'importe où : un navigateur, un serveur, un objet connecté ou une gateway sur l'Edge. Le runtime traduit à la volée les instructions Wasm en code machine natif, garantissant des performances quasi-natives tout en isolant complètement le code du système hôte.

Cette isolation est cruciale. Par défaut, un module Wasm ne peut rien faire : il n'a accès ni au système de fichiers, ni au réseau, ni à aucune ressource système. C'est un "bac à sable" (sandbox) parfait, ce qui en fait une technologie incroyablement sécurisée dès sa conception.

| Caractéristique | WebAssembly (Wasm) | Conteneur Docker |

|---|---|---|

| Isolation | Sandbox au niveau du processus (très forte) | Isolation au niveau de l'OS (namespaces, cgroups) |

| Taille | Quelques Ko ou Mo | Des dizaines ou centaines de Mo |

| Démarrage à froid | Quelques microsecondes à millisecondes | Quelques centaines de millisecondes à secondes |

| Portabilité | Indépendant de l'OS et de l'architecture CPU | Dépendant de l'architecture CPU (x86/ARM) |

Le rôle clé de WASI : L'interface système

Pendant longtemps, le principal obstacle à l'utilisation de Wasm côté serveur était son incapacité à communiquer avec le monde extérieur. Comment un module Wasm pouvait-il lire un fichier, ouvrir une connexion réseau ou même simplement afficher du texte dans la console s'il était confiné dans sa sandbox ?

La réponse est venue avec WASI (WebAssembly System Interface). Pensez à WASI comme à une API standardisée et sécurisée qui sert de pont entre le module Wasm et le système d'exploitation hôte. C'est l'équivalent des appels système (syscalls) dans un OS traditionnel, mais avec une approche radicalement différente.

Au lieu de laisser le module Wasm appeler n'importe quelle fonction système, le modèle de WASI est basé sur les capacités. Concrètement, c'est l'hôte (le runtime Wasm) qui injecte explicitement les permissions dans le module au démarrage. Par exemple, vous pouvez autoriser un module à lire uniquement le fichier /config/app.json et à ouvrir une connexion sortante sur le port 443, et rien d'autre. Toute tentative d'accès à une autre ressource sera immédiatement bloquée.

Voici un exemple conceptuel en Rust, qui serait compilé en Wasm. Le code lui-même est simple, mais c'est le runtime qui lui donnera (ou non) la permission d'écrire dans la console.

// Fichier: src/main.rs

// On utilise la bibliothèque wasi pour accéder au stdout

use std::io::{self, Write};

fn main() {

// Cet appel ne fonctionnera que si le runtime a injecté

// la capacité "stdout" dans notre module Wasm.

let mut stdout = io::stdout();

stdout.write_all(b"Hello, from WebAssembly on the server!\n").unwrap();

}Applications Pratiques : Wasm sur l'Edge et dans le Cloud

Edge Computing : La performance au plus près de l'utilisateur

L'Edge Computing consiste à exécuter du code non pas dans de grands datacenters centralisés, mais sur une multitude de petits serveurs répartis géographiquement, au plus près des utilisateurs finaux. L'objectif est de réduire drastiquement la latence pour des applications comme le streaming vidéo, les jeux en ligne ou l'analyse de données IoT en temps réel.

Dans ce contexte, les conteneurs Docker traditionnels montrent leurs limites : leur taille et leur temps de démarrage peuvent être un frein sur des appareils aux ressources limitées. C'est là que WebAssembly excelle. Un module Wasm est extrêmement léger et démarre quasi instantanément, ce qui le rend parfait pour exécuter des fonctions à la demande sur des points de présence (PoP) Edge.

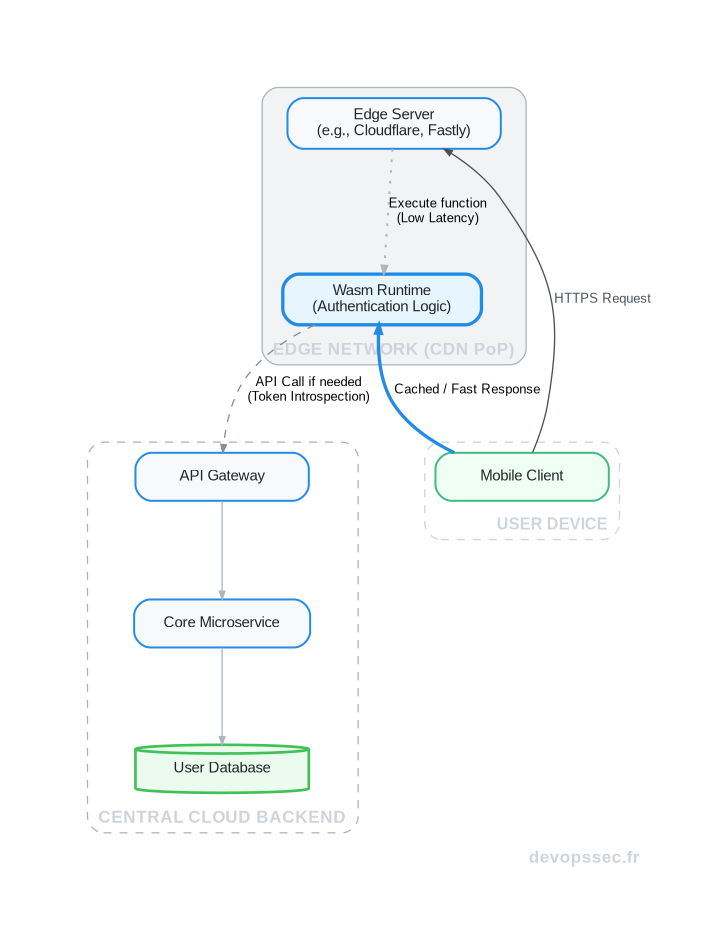

Concrètement, un CDN moderne pourrait utiliser Wasm pour permettre à ses clients d'exécuter du code personnalisé (redirection, authentification, modification de headers) directement sur le CDN, sans que la requête n'ait à faire un aller-retour vers le serveur d'origine. C'est plus rapide, plus efficace et plus sécurisé.

Microservices et Serverless : La nouvelle agilité

Dans l'écosystème Cloud Native, la tendance est aux applications décomposées en microservices de plus en plus petits et spécialisés. Le modèle Serverless (ou FaaS - Function as a Service) pousse cette logique à l'extrême. WebAssembly s'intègre parfaitement dans cette vision.

Plutôt que de packager une simple fonction dans un conteneur complet avec son propre OS, on peut la packager en un module Wasm de quelques mégaoctets. Le gain est spectaculaire : des démarrages plus rapides, une consommation de ressources moindre et une densité bien plus élevée sur un même serveur. On peut faire tourner des milliers de modules Wasm là où on ne pourrait en faire tourner que quelques dizaines de conteneurs.

De plus, Wasm favorise le polyglottisme. Une équipe peut écrire une fonction en Go, une autre en Rust et une troisième en C#, les compiler en Wasm, et les déployer sur la même infrastructure sans aucune friction. C'est la promesse d'une véritable interopérabilité au niveau binaire.

Attention à l'écosystème

Malgré ses promesses, l'écosystème Wasm côté serveur est encore jeune. Le débogage peut être plus complexe que pour une application native, et l'accès à certaines fonctionnalités système avancées (comme les threads ou les sockets brutes) est encore en cours de standardisation via des propositions comme WASI-Threads ou WASI-Sockets. C'est une technologie à surveiller de près, mais qui demande encore de la maturité pour certains cas d'usage critiques.

Conclusion : Vers une infrastructure unifiée

WebAssembly n'est plus ce gadget technique cantonné aux navigateurs. Il s'affirme aujourd'hui comme un runtime universel, sécurisé et performant qui répond à de nombreuses problématiques de l'infrastructure moderne, de la fonction Serverless éphémère au traitement de données en temps réel sur l'Edge.

Il ne s'agit pas de remplacer les conteneurs, qui restent la solution de choix pour des applications complexes et monolithiques. Il s'agit plutôt de les compléter, en offrant une solution plus fine et plus adaptée pour les charges de travail granulaires où la performance de démarrage et la sécurité sont primordiales.

Pour toi, jeune professionnel de la tech, comprendre les fondements et le potentiel de WebAssembly au-delà du navigateur, c'est te préparer à la prochaine vague d'innovation dans le domaine du Cloud Native. C'est un outil de plus dans ta boîte à outils, un outil puissant qui pourrait bien devenir incontournable dans les années à venir.

Espace commentaire

Écrire un commentaire

Vous devez être connecté pour poster un message !

15 commentaires

ça confirme ma vision de wasm pour nos fonctions serverless, merci

Good stuff sur le Binaire Universel pour le Cloud Native

le rôle clé de wasi c'est vraiment le truc qui va débloquer plein de cas d'usage

Fini les problèmes de dépendances spécifiques à chaque OS ou arch, enfin presque

la nouvelle agilité avec microservices et serverless, c'est l'avenir

Les applications pratiques sont bien expliquées

L'infrastructure unifiée, c'est ce qu'on essaie de construire

Wasm est clairement un pilier pour atteindre cet objectif

On vient de benchmarker Wasm pour certains de nos worker functions, les perfs sont dingues

Super intéressant le Qu'est-ce que Wasm, concrètement ?, ça clarifie pas mal de choses

Wasm, une révolution silencieuse, je suis d'accord à 100%

La performance au plus près de l'utilisateur en Edge Computing c notre next step

cet article donne des pistes concrètes pour s'y mettre

Les Microservices et Serverless avec Wasm c'est la nouvelle agilité, clair

Vraiment top la partie sur l'Edge Computing

ce binaire universel pour le cloud native c la promesse qu'on attendait

Le rôle clé de WASI pour l'interface système est ultra pertinent pour notre stack

On réfléchit justement à la portabilité des services cross-platform

Wasm sur l'Edge ça démonte